18.4.2026

Warum ki on premise? Der Ratgeber für 2026

Lohnt sich ki on premise für Ihr Unternehmen? Wir decken die Kosten auf und zeigen, warum eine DSGVO-konforme Cloud 2026 oft der smartere Weg ist.

TL;DR: KI on premise ist möglich, aber der Einstieg ist teuer. Allein eine Starter-Infrastruktur mit 4 bis 8 H100-GPUs kostet ca. 200.000 bis 500.000 €. Für die meisten Unternehmen ist eine DSGVO-konforme, europäisch gehostete Lösung wirtschaftlich vernünftiger und organisatorisch sauberer. Datensouveränität ist kein Hardware-Problem, sondern eine Frage des richtigen Anbieters und der richtigen Vertrags- und Betriebsarchitektur.

Der IT-Leiter eines Mittelständlers sagte mir einmal sinngemäss: Wir wollen bei KI auf Nummer sicher gehen, also vielleicht alles bei uns im Haus betreiben. Zwei Gespräche später ging es dann um GPU-Server, Kühlung, Betrieb, Updates und Ausfallsicherheit. Da wurde aus dem Wunsch nach Kontrolle plötzlich ein eigenes Infrastrukturprogramm.

Genau da liegt der Denkfehler bei ki on premise.

Der Denkfehler vom eigenen Fuhrpark bei KI On-Premise

Ein Unternehmen braucht Dienstwagen. Also baut es eine eigene Werkstatt, stellt Spezialisten ein, lagert Ersatzteile, organisiert Wartung, Versicherungen und Ersatzfahrzeuge. Klingt absurd. Die meisten Firmen wählen stattdessen einen verlässlichen Leasing- oder Flottenpartner mit klaren Verträgen, Service-Leveln und Haftungsregeln.

Bei KI passiert gerade oft genau dieser Werkstatt-Fehler.

Was Unternehmen eigentlich meinen

Wenn Geschäftsführer oder Compliance-Verantwortliche „ki on premise“ sagen, meinen sie meist nicht, dass sie begeistert Server beschaffen wollen. Sie meinen etwas anderes:

- Keine unkontrollierte Datenweitergabe an beliebige US-Dienste

- Klare Zugriffsrechte für Mitarbeitende und Teams

- Nachvollziehbare Verarbeitung sensibler Inhalte

- Souveränität über den Datenstandort und den Betriebsrahmen

Das sind legitime Anforderungen. Aber daraus folgt nicht automatisch, dass Sie selbst Hardware betreiben müssen.

Wer sichere Firmenwagen will, baut keine eigene Werkstatt. Wer sichere KI will, braucht keinen Serverkeller, sondern einen Anbieter mit den richtigen Zusagen und dem richtigen Betriebsmodell.

Wo die Fehlentscheidung entsteht

Viele Unternehmen springen bei KI direkt auf die Infrastrukturfrage. Lokal oder Cloud. Eigenbetrieb oder nicht. Das ist zu früh und oft falsch.

Die richtige Reihenfolge ist diese:

- Zuerst den Schutzbedarf klären. Welche Daten dürfen wohin, welche nicht?

- Dann den Betriebsaufwand ehrlich bewerten. Haben Sie wirklich das Team für GPU-Betrieb, Modellpflege und Security?

- Erst danach die Architektur wählen. On-Premise, gemanagt in der EU oder hybrid.

Ich sage das bewusst klar: Für die meisten Unternehmen ist der Besitz der Hardware kein strategischer Vorteil. Er ist ein zusätzlicher Kosten- und Komplexitätsblock.

Der Wunsch nach Kontrolle ist richtig. Der Schluss daraus oft nicht.

Viele Firmen verwechseln Kontrolle mit Besitz. Das kennen wir aus anderen IT-Bereichen. Niemand würde heute ernsthaft behaupten, nur eine selbst betriebene Exchange-Umgebung sei „echte“ Kommunikation. Entscheidend ist, welche Verträge, Sicherheitsmassnahmen, Hosting-Regionen, Rollenmodelle und Löschkonzepte gelten.

Bei KI ist es genauso. Der Wunsch nach Datensouveränität ist vernünftig. Der reflexhafte Ruf nach ki on premise ist es oft nicht.

Was „KI On-Premise“ wirklich bedeutet

Montagmorgen, 8:30 Uhr. Der Fachbereich will einen internen KI-Assistenten für Angebote, Support und Wissenssuche. In der Runde fällt schnell der Satz: „Dann machen wir es eben on premise, dann sind die Daten sicher.“ Genau an dieser Stelle kippt die Diskussion oft in die falsche Richtung.

KI On-Premise bedeutet nicht nur lokale Datenhaltung. Es bedeutet, dass Ihr Unternehmen die technische und organisatorische Verantwortung für den KI-Betrieb selbst übernimmt. Dazu gehören Rechenleistung, Speicher, Netzwerk, Zugriffsrechte, Modellbereitstellung, Monitoring, Patches, Sicherheitsvorfälle und Verfügbarkeit.

Der Punkt wird in vielen Projekten zu weich formuliert. Ich würde es klarer sagen: Wer sich für KI on premise entscheidet, kauft keine Lösung ein, sondern einen dauerhaften Betriebsauftrag. Genau deshalb ist das Thema am Ende eine TCO-Frage und keine reine Architekturfrage.

Die technische Realität

Sobald aus einem Test ein Unternehmenssystem werden soll, brauchen Sie mehr als einen lokal installierten Dienst auf irgendeinem Server.

Typisch sind diese Bausteine:

- GPU-Systeme statt Standard-Server. Sprachmodelle brauchen spezialisierte Hardware, wenn Antwortzeiten und Auslastung im Alltag stimmen sollen.

- Geeignete Strom- und Kühlkapazitäten. KI-Workloads laufen nicht nebenbei im vorhandenen Rack, nur weil dort noch Höheneinheiten frei sind.

- Modellbetrieb mit Versionskontrolle. Modelle müssen bereitgestellt, aktualisiert, dokumentiert und kontrolliert zurückgerollt werden können.

- Identitäts- und Rechtemanagement. Ohne saubere Rollen, Mandantenfähigkeit und Protokollierung wird aus dem Projekt schnell ein Compliance-Problem.

- Monitoring, Backup und Wiederanlauf. Auch lokale Systeme fallen aus. Dann zählt nicht die Theorie, sondern ob der Betrieb am selben Tag wieder steht.

Das ist keine Ausnahme. Das ist der Normalfall.

Die organisatorische Realität

Viele Unternehmen unterschätzen nicht die Technik, sondern den Alltag danach. Ein KI-System produziert laufende Arbeit. Jemand muss Zuständigkeiten festlegen, Änderungen freigeben, Logs prüfen, Sicherheitslücken bewerten und Fachbereiche betreuen.

Praxisregel: Wenn Ihre IT heute schon mit ERP, M365, Clients, Netzwerk und Security ausgelastet ist, haben Sie faktisch kein freies Team für den stabilen KI-Betrieb.

Hinzu kommt die Governance. Sie müssen festlegen, welche Modelle überhaupt lokal betrieben werden, welche Daten angebunden werden dürfen, wie Prompts und Ergebnisse dokumentiert werden und wer bei Fehlverhalten eingreift. Ohne diese Regeln betreiben Sie keine souveräne Unternehmens-KI, sondern eine teure Insellösung.

On-Premise ist nicht gleich lokal installiert

Ein lokaler Test auf einem Notebook oder einem einzelnen Server ist noch kein On-Premise-Betriebsmodell. Das eine ist ein Versuch. Das andere ist eine produktive Plattform mit Anforderungen an Verfügbarkeit, Sicherheit, Rollen, Support und Lebenszyklus.

Wenn Sie diese Abgrenzung sauber verstehen wollen, lesen Sie den Beitrag KI lokal installieren im Unternehmenskontext. Dort wird der Unterschied zwischen technischer Machbarkeit und belastbarem Unternehmensbetrieb praxisnah erklärt.

Für die meisten Unternehmen ist genau das die entscheidende Einsicht: Datensouveränität entsteht nicht automatisch durch eigene Hardware. Sie entsteht durch klare Verträge, europäischen Betrieb, saubere Prozesse und eine Betriebsverantwortung, die Sie auch dauerhaft tragen können. Wer das ehrlich bewertet, landet oft nicht im eigenen Serverkeller, sondern bei einer gemanagten europäischen Lösung, die Kontrolle gibt, ohne den vollen Infrastrukturballast ins Haus zu holen.

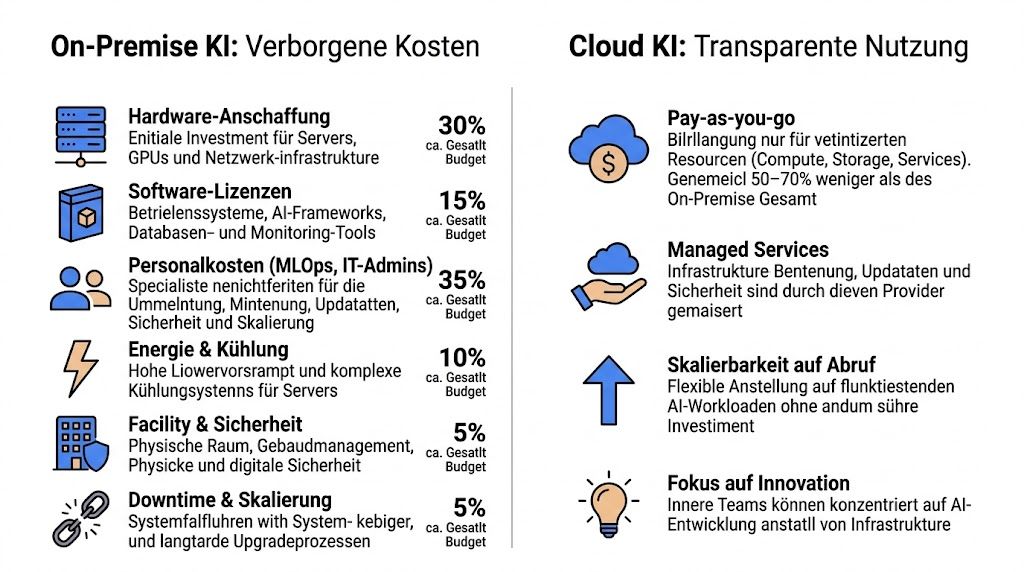

Die brutale Kostenwahrheit einer eigenen KI-Infrastruktur

Hier wird es ungemütlich. Viele Unternehmen sprechen über On-Premise, als ginge es nur um eine Lizenzform. Tatsächlich sprechen wir über Investitionskosten, Betriebskosten und Opportunitätskosten.

Für echte KI-On-Premise-Lösungen sind GPU-Server Pflicht. Kleinere Modelle kommen mit GPUs ab 24 GB VRAM aus. Grössere Modelle brauchen Multi-GPU-Setups mit NVIDIA A100 oder H100. Eine Starter-Infrastruktur mit 4 bis 8 H100-GPUs kostet ca. 200.000 bis 500.000 € (technische und finanzielle Einstiegshürde bei KI On-Premise).

Die Kosten, die in Präsentationen gern fehlen

Die Anschaffung ist nur der sichtbare Teil. Danach kommen die Positionen, die intern fast immer zu klein geschätzt werden:

- Betrieb und Wartung. Jemand muss Treiber, Container, Laufzeitumgebungen und Sicherheitsupdates pflegen.

- Strom und Kühlung. GPUs sind keine stromsparenden Büroanwendungen.

- Ausfallsicherheit. Ein einzelner Server ist keine produktionsreife Unternehmensplattform.

- Interne Spezialisten. Ohne MLOps, Plattformbetrieb und Security wird das keine stabile Umgebung.

- Manuelle Modellpflege. Neue Modelle oder neue Versionen kommen nicht automatisch sauber in Ihre Landschaft.

Die Opportunitätskosten sind der eigentliche Hammer

Der grösste Denkfehler ist aber ein anderer. Firmen rechnen die Hardware und vergessen die Zeit ihrer eigenen Leute.

Wenn Ihr IT-Team eine On-Premise-KI betreibt, arbeitet es an Themen wie GPU-Auslastung, Storage, Patches, Monitoring und Rollbacks. Es arbeitet dann nicht an Prozessintegration, Wissensnutzung, Governance oder produktiven Assistenten für Vertrieb, HR, Support und Verwaltung.

Die wichtigste Frage lautet nicht: Können wir KI on premise aufbauen? Die wichtigere Frage lautet: Wollen wir unser Team dafür binden?

Wenn Sie die Wirtschaftlichkeit von Spezialhardware besser einordnen wollen, lohnt sich ein Blick auf Kosten und Leistung von Google Tensor Processing Units. Nicht weil TPUs Ihr Standardweg sein müssen, sondern weil der Vergleich zeigt, wie schnell Infrastrukturentscheidungen in Architektur- und Kostenfragen kippen.

Ein nüchterner Vergleich

| Kostenfaktor | KI On-Premise (Eigenbetrieb) | Gemanagte Plattform (z.B. innoGPT) |

|---|---|---|

| Anschaffung | Hohe Anfangsinvestition für GPU-Hardware | Kein eigener Hardwarekauf |

| Betrieb | Internes Team für Wartung und Sicherheit nötig | Betrieb liegt beim Anbieter |

| Updates | Modell- und Plattformupdates manuell einplanen | Updates werden zentral bereitgestellt |

| Skalierung | Kapazität muss vorab geplant und beschafft werden | Nutzung wird je nach Bedarf erweitert |

| Compliance | Muss intern technisch und organisatorisch umgesetzt werden | Muss vertraglich und technisch sauber geprüft werden |

| Time-to-Value | Langsamer, weil Infrastruktur zuerst gebaut wird | Schneller, weil Nutzung früher starten kann |

Was ich Mittelständlern konkret rate

Für den Mittelstand ist ki on premise nur dann sinnvoll, wenn Sie einen sehr klaren Grund haben, der über ein allgemeines Sicherheitsgefühl hinausgeht. „Wir möchten lieber alles bei uns“ ist kein Business Case.

Wenn Sie stattdessen erst verstehen wollen, wie man ein belastbares KI-System fachlich aufsetzt, bevor man in Infrastruktur investiert, ist ein praktischer Blick auf das Erstellen von KI-Modellen im Unternehmenskontext deutlich wertvoller als die vorschnelle Serverbestellung.

Meine klare Empfehlung: Rechnen Sie zuerst die internen Betriebsfolgen. Nicht nur die Hardware. Sonst kaufen Sie Blech und merken zu spät, dass Ihnen der eigentliche Engpass im Betrieb sitzt.

Für wen sich On-Premise KI trotzdem lohnen kann

Es gibt Fälle, in denen ich ki on premise ausdrücklich für vernünftig halte. Aber das sind Ausnahmen, keine Standardempfehlung.

On-Premise-KI bietet maximale Datensouveränität durch lokale Hardware. Sie kann die Latenz gegenüber Cloud deutlich senken, laut Databricks um bis zu 90 %, mit unter 10 ms lokal in passenden Szenarien. Das ist für regulierte Branchen und Echtzeit-Anwendungen relevant (Datensouveränität und Latenzvorteile lokaler KI-Infrastruktur).

Diese drei Gruppen sind echte Kandidaten

Erstens: Hochsicherheitsbereiche mit Air-Gap-Anforderungen.

Wenn Systeme bewusst von externen Netzen getrennt bleiben müssen, ist ein lokaler Betrieb keine Komfortfrage, sondern Vorgabe. Das betrifft etwa bestimmte Behörden, sicherheitskritische Forschungsumgebungen oder Verteidigungsprojekte.

Zweitens: Konzerne mit bestehender Enterprise-Infrastruktur.

Wenn ein Unternehmen bereits eigene Rechenzentren, Security-Teams, Plattformbetrieb und erfahrene KI-Spezialisten hat, sieht die Rechnung anders aus. Dann wird On-Premise nicht neu aufgebaut, sondern in vorhandene Strukturen integriert.

Drittens: Bereiche mit echter lokaler Verarbeitungspflicht.

In manchen Umfeldern reicht „EU-Hosting“ politisch oder regulatorisch nicht aus. Dann ist lokale Datenhaltung im eigenen Einflussbereich schlicht die notwendige Betriebsform.

Wer meistens nicht dazugehört

Viele Mittelständler ordnen sich emotional in diese Gruppe ein, operativ aber nicht. Sie haben keinen Air-Gap, kein eigenes KI-Plattformteam und kein bestehendes GPU-Betriebsmodell. Sie haben nur verständliche Sorge um Datenschutz.

Das reicht nicht für eine gute On-Premise-Entscheidung.

Wenn Ihr Hauptziel Datenschutz, Zugriffskontrolle und klare Compliance ist, brauchen Sie oft keinen Eigenbetrieb. Sie brauchen einen sauber aufgesetzten europäischen Betriebsrahmen.

Ein einfacher Realitätstest

Stellen Sie sich drei Fragen:

- Müssen Ihre Systeme technisch vollständig isoliert laufen?

- Haben Sie bereits die Teams für 24/7-Betrieb, Security und Plattformpflege?

- Ist lokale Inferenz in Millisekunden geschäftskritisch?

Wenn Sie diese Fragen nicht klar mit Ja beantworten, wird On-Premise oft zur überteuerten Sicherheitsgeste. Dann wirkt es intern entschlossen, bremst aber in der Praxis die Umsetzung.

Datensouveränität ohne Serverkeller der intelligente Mittelweg

Der deutsche KI-Markt soll von 9 Mrd. € im Jahr 2025 auf 37 Mrd. € bis 2031 wachsen, bei einer prognostizierten CAGR von 26 %. Getrieben wird das laut Vention stark vom Wunsch nach Datenstandort-Souveränität. Gleichzeitig betont die Quelle, dass sichere, gemanagte Plattformen mit EU-Hosting und SSO-Integration Compliance ermöglichen, ohne die Komplexität eigener On-Premise-Rechenzentren (Projektion des deutschen KI-Markts und Rolle gemanagter EU-Plattformen).

Das ist der Punkt, den viele Unternehmen zu spät verstehen. Sie wollen nicht zwingend eigene Hardware. Sie wollen Kontrolle, Datenschutz, Rollensteuerung und verlässliche Verträge.

Was der intelligente Mittelweg leisten muss

Eine vernünftige Alternative zu ki on premise muss vier Dinge gleichzeitig erfüllen:

- EU-Hosting und klarer Datenstandort

- Kein Training mit Kundendaten, also Zero Retention oder vergleichbare Zusagen

- SSO, Rollenrechte und administrative Kontrolle

- Schneller operativer Einsatz ohne Infrastrukturprojekt

Wenn ein Anbieter diese Punkte belastbar erfüllt, bekommen Sie den eigentlichen Nutzen von „On-Premise-Denken“ ohne den Ballast des Eigenbetriebs.

Wo eine gemanagte europäische Lösung Sinn ergibt

Für die meisten Fachbereiche ist das die bessere Balance. Vertrieb will Angebote schneller erstellen. HR will Richtlinien, Stellenprofile und interne Kommunikation konsistent bearbeiten. Support will Wissen nutzbar machen. Rechts- und Compliance-Teams wollen nachvollziehbare Rahmenbedingungen.

Dafür müssen diese Teams nicht auf einen GPU-Cluster im Keller warten.

Ein Beispiel für diesen Mittelweg ist innoGPT. Die Plattform arbeitet mit EU-Hosting, Zero Retention, SSO, rollenbasierter Zugriffskontrolle sowie Integrationen wie SharePoint und Teams. Damit adressiert sie genau das, was Unternehmen bei ki on premise oft eigentlich suchen: Kontrolle und DSGVO-konforme Nutzung ohne eigenen Plattformbetrieb.

Die ehrliche Schlussfolgerung

Datensouveränität entsteht nicht dadurch, dass Sie Metall besitzen. Sie entsteht durch Architektur, Verträge, Hosting-Ort, Zugriffskontrolle und klare Betriebsregeln.

Das ist der intelligentere Weg für fast alle Unternehmen, die produktiv mit KI arbeiten wollen, aber keinen zweiten Infrastrukturapparat aufbauen möchten.

Das akute Problem der Schatten-IT in Ihrem Unternehmen

Montagmorgen, 8:17 Uhr. Ein Vertriebsmitarbeiter kopiert eine Kundenmail in ein öffentliches KI-Tool, weil das Angebot bis 9 Uhr raus muss. In HR lässt sich parallel jemand eine Formulierung für eine Abmahnung umschreiben. Der Fachbereich wartet nicht auf Ihr Architekturprojekt. Er baut sich seine eigene KI-Nutzung.

Genau so beginnt Schatten-IT bei KI. Leise, pragmatisch und aus Sicht der Mitarbeitenden oft völlig nachvollziehbar.

Das Problem ist nicht zuerst die Technik. Das Problem ist das Vakuum, das Sie im Betrieb lassen. Wenn das offizielle Angebot fehlt, greifen Teams zu dem, was sofort verfügbar ist. Dann landen Inhalte in Tools, die niemand freigegeben hat. Prompts werden privat gespeichert. Ergebnisse werden weiterverwendet, ohne dass Herkunft, Freigabe oder Datenfluss sauber geregelt sind.

Das ist kein Randthema. Es ist eine direkte Folge davon, dass viele Unternehmen die Debatte über ki on premise zu lange als Infrastrukturfrage führen, obwohl das operative Risiko längst im Alltag entsteht.

Das eigentliche Paradox

Ein langes On-Premise-Projekt wirkt auf dem Papier kontrolliert. In der Praxis verlängert es oft nur die Phase ohne Regeln, ohne freigegebene Werkzeuge und ohne sichtbare Verantwortung.

Die Folge sehen Sie in fast jedem Unternehmen, das KI zwar diskutiert, aber nicht sauber bereitstellt:

- Fachbereiche nutzen öffentliche Tools auf eigene Faust.

- Antworten an Kunden, Bewerber oder Partner unterscheiden sich je nach Person und Tool.

- Wissen verteilt sich auf private Prompt-Sammlungen, lokale Dateien und Chatverläufe.

- Compliance prüft zu spät, welche Daten bereits verarbeitet wurden.

So steigen die Gesamtkosten. Nicht nur durch mögliche Datenschutzprobleme, sondern auch durch Mehrarbeit, doppelte Prozesse, inkonsistente Ergebnisse und spätere Aufräumprojekte. Genau hier wird die TCO-Debatte ehrlich. Der teuerste Weg ist oft nicht die Rechnung für Hardware. Der teuerste Weg ist ungeordnete Nutzung ohne Steuerung.

Woran Sie das Problem erkennen

Schatten-KI taucht selten zuerst im Reporting auf. Sie sehen sie an kleinen, wiederkehrenden Signalen:

- Mitarbeitende fragen im Nebensatz, ob sie „kurz ein externes Tool“ verwenden dürfen.

- Teams dokumentieren Prompts in privaten Notizen statt in einem freigegebenen System.

- Einzelne Abteilungen bauen Mini-Workflows ausserhalb der IT auf.

- Führungskräfte bekommen fertige KI-Ergebnisse zu sehen, kennen aber den Prozess dahinter nicht.

Ein Satz reicht oft als Warnsignal: „Wir testen das erstmal selbst.“

Was Sie jetzt tun sollten

Warten Sie nicht auf das perfekte Zielbild. Setzen Sie zuerst einen kontrollierten Standard. Geben Sie den Fachbereichen ein freigegebenes Werkzeug mit klaren Regeln für Zugriff, Datenverarbeitung, Rollen und Dokumentation.

Für die meisten Unternehmen ist das der vernünftigere Weg als ein langes Eigenbetriebsprojekt. Sie bekommen Datensouveränität dort, wo sie im Alltag zählt, ohne parallel monatelang eine eigene Infrastruktur aufzubauen, die Budget bindet und das eigentliche Problem nicht stoppt.

Meine Empfehlung ist klar: Reduzieren Sie Schatten-IT sofort mit einer gemanagten, europäisch betriebenen Lösung. Das ist für die meisten Unternehmen der intelligentere Weg zu Kontrolle, Compliance und kalkulierbaren Betriebskosten.

Checkliste zur Auswahl des richtigen KI-Partners

Wenn Sie keine eigene KI-Infrastruktur aufbauen wollen, müssen Sie den Anbieter strenger prüfen. Nicht nach Werbeslogans, sondern nach Betriebsrealität.

Die Fragen, die Sie stellen sollten

Wo werden Daten gehostet und verarbeitet?

EU-Hosting sollte keine Marketingformel sein, sondern vertraglich und technisch nachvollziehbar.Gibt es eine klare Regel zum Umgang mit Kundendaten?

Fragen Sie nach Zero Retention oder einem gleichwertig konkreten Datenverarbeitungsmodell.Wie funktioniert der Zugriff im Unternehmen?

SSO, Rollenrechte und administrative Steuerung sind kein Extra. Sie sind Pflicht.Wie werden Modelle und Funktionen aktualisiert?

Sie wollen nicht jede Weiterentwicklung als internes IT-Projekt behandeln.

Die Antworten, die Sie nicht akzeptieren sollten

Bestimmte Formulierungen sind Warnzeichen. Zum Beispiel:

- „Datenschutz ist uns wichtig.“ Das sagt nichts.

- „Unsere Infrastruktur ist sicher.“ Wodurch genau?

- „On-Premise ist bei Bedarf möglich.“ Unter welchen Voraussetzungen, mit welchem Betriebsmodell?

- „Wir sind flexibel.“ Flexibilität ohne Governance ist kein Vorteil.

Eine kurze Bewertungsmatrix

| Prüfkriterium | Gute Antwort | Schlechte Antwort |

|---|---|---|

| Datenstandort | EU klar benannt und vertraglich abgesichert | „Global verteilt, aber sicher“ |

| Datennutzung | Keine Nutzung von Kundendaten für Training ohne Freigabe | Unklare Standardklauseln |

| Zugriffsmodell | SSO und Rollensteuerung vorhanden | Einzelaccounts ohne zentrale Verwaltung |

| Integration | Anschluss an bestehende Tools möglich | Isolierte Einzellösung |

| Betriebsmodell | Updates und Wartung klar geregelt | Viel Eigenverantwortung beim Kunden |

Worauf ich besonders achten würde

- Vertrag vor Demo. Erst die Betriebsbedingungen prüfen, dann die Oberfläche bestaunen.

- Admin-Fähigkeit statt Spielerei. Fachlich nette Features helfen wenig, wenn Governance fehlt.

- Einführbarkeit in Wochen, nicht in Projektsaisons. Sonst gewinnt wieder die Schatten-IT.

- Dokumentierte Sicherheit. Zertifizierungen, Zugriffskonzepte und Löschlogik müssen nachprüfbar sein.

Ein guter KI-Partner verkauft Ihnen nicht nur ein Modell. Er übernimmt einen Teil Ihres Betriebsrisikos.

Wenn ein Anbieter diese Punkte nicht sauber beantwortet, ist er kein souveräner Partner, sondern nur ein weiteres Tool.

Fazit Ihr Weg zur smarten und sicheren KI-Nutzung

ki on premise ist real. Es ist technisch machbar. Für einige Organisationen ist es sogar notwendig.

Für die grosse Mehrheit ist es trotzdem nicht der klügste Weg.

Der Grund ist einfach. On-Premise verschiebt das Problem nicht weg, sondern zu Ihnen. Sie tragen dann Hardware, Betrieb, Updates, Verfügbarkeit, Sicherheit und internes Know-how selbst. Das kann richtig sein, wenn Sie Air-Gap-Vorgaben, bestehende Rechenzentrumsstrukturen oder echte lokale Echtzeit-Anforderungen haben.

Für die meisten Unternehmen ist aber etwas anderes wichtiger: schnell kontrolliert produktiv werden, Datenschutz sauber abbilden, Schatten-IT stoppen und Fachbereiche arbeitsfähig machen.

Genau deshalb sollten Sie Datensouveränität nicht mit Hardware-Besitz verwechseln. Die bessere Frage lautet nicht: Müssen wir KI on premise betreiben? Die bessere Frage lautet: Mit welchem Betriebsmodell bekommen wir Sicherheit, Kontrolle und Nutzen ohne unnötigen Infrastrukturballast?

Meine Empfehlung ist klar. Prüfen Sie On-Premise nur dann ernsthaft, wenn Sie einen harten fachlichen oder regulatorischen Grund haben. In allen anderen Fällen fahren Sie klüger mit einer gemanagten, DSGVO-konformen europäischen Lösung, die Kontrolle liefert, ohne Ihre IT in ein Infrastrukturprojekt zu verwandeln.

Häufig gestellte Fragen zu KI On-Premise

Reicht nicht einfach ein starker Server im Büro

Meistens nein. Ein einzelner kräftiger Server ist noch keine Unternehmensplattform für KI. Für moderne Sprachmodelle brauchen Sie nicht nur Rechenleistung, sondern auch saubere Benutzerverwaltung, Monitoring, Ausfallsicherheit, Sicherheitsupdates und einen geregelten Modellbetrieb. Ein Testsystem ist schnell aufgebaut. Ein belastbarer Produktivbetrieb nicht.

Sind hybride Modelle ein sinnvoller Mittelweg

Ja, aber nur wenn Sie genau wissen, warum. Hybrid kann bedeuten, dass sensible Daten lokal bleiben und andere Workloads über einen gemanagten Dienst laufen. Das kann sinnvoll sein, erhöht aber die Komplexität. Wer schon mit einem einfachen Setup organisatorisch ringt, sollte nicht reflexartig ein hybrides Zielbild entwerfen.

Wie prüfe ich die Sicherheit einer Cloud-Lösung konkret

Nicht nach Bauchgefühl. Fragen Sie nach Hosting-Ort, Auftragsverarbeitung, Rollen- und Rechtemodell, SSO, Verschlüsselung, Auditierbarkeit und dem Umgang mit Kundendaten. Lassen Sie sich dokumentierte Sicherheits- und Betriebsinformationen zeigen. Wenn Antworten vage bleiben, ist das kein gutes Zeichen.

Wenn Sie KI im Unternehmen sicher nutzen wollen, ohne sich in einem teuren On-Premise-Projekt zu verheddern, schauen Sie sich innoGPT nüchtern an. Prüfen Sie Hosting, Zero Retention, SSO, Rollensteuerung und Integrationen gegen Ihre Anforderungen. Genau so sollte eine Entscheidung heute getroffen werden.

Lass dir innoGPT in 15 Minuten zeigen.

Wir nehmen uns gerne Zeit für dich!