17.4.2026

Llm hosting deutschland: LLM Hosting Deutschland: Sicher &

Entdecken Sie, warum llm hosting deutschland 2026 für Ihre Datensicherheit und DSGVO-Konformität entscheidend ist. Der ultimative Guide für den Mittelstand.

tl;dr:

- LLM Hosting in Deutschland bedeutet: Ihre Daten verlassen nie den europäischen Rechtsraum.

- DSGVO-Konformität ist kein Nice-to-have, sondern ein echter Wettbewerbsvorteil.

- Plattformen wie innoGPT machen sicheres, EU-gehostetes LLM-Hosting ohne eigene Infrastruktur möglich.

Es ist Dienstagnachmittag. Ihr Vertriebsmitarbeiter tippt gerade den kompletten Entwurf eines Kundenvertrags in ein KI-Tool, das auf einem Server in Virginia läuft. Er denkt: Spart mir eine Stunde. Sie denken, wenn Sie es wüssten: Das war ein Datenschutzvorfall.

Das Problem ist nicht die KI. Das Problem ist unkontrollierte KI.

Wenn Sie als Geschäftsführer, IT-Leiter oder Datenschutzverantwortlicher in einem deutschen KMU gerade prüfen, wie Sie generative KI sauber einführen, dann ist llm hosting deutschland keine technische Nebenfrage. Es ist die Grundsatzentscheidung darüber, ob Ihr Unternehmen produktiver wird oder sich unnötig rechtliche und operative Risiken einkauft.

Ein Datenschutzvorfall in 60 Sekunden

Der typische Ablauf ist banal. Ein Mitarbeiter kopiert eine Kundenmail in ein frei verfügbares KI-Tool. Danach folgt ein Vertragsentwurf. Dann eine Reklamation mit Namen, Ansprechpartnern und internen Notizen. Niemand meldet etwas, weil niemand glaubt, etwas Falsches getan zu haben.

Genau so entsteht Schatten-IT. Nicht aus bösem Willen, sondern aus Zeitdruck.

Was in diesem Moment schiefläuft

Wenn Ihr Team ein beliebiges US-KI-Tool nutzt, geben Mitarbeitende unter Umständen personenbezogene Daten, Geschäftsgeheimnisse oder Vertragsinhalte an einen Dienst weiter, dessen Datenfluss sie weder verstehen noch kontrollieren. Für den Anwender ist das bequem. Für das Unternehmen ist es ein Blindflug.

Besonders heikel wird es, wenn der Text sensible Inhalte enthält. Das betrifft nicht nur HR und Rechtsabteilung. Auch Vertrieb, Kundenservice, Einkauf und Projektmanagement arbeiten täglich mit Daten, die nicht in eine fremde Black Box gehören.

Praktische Regel: Sobald ein Mitarbeiter echte Kundendaten, Bewerberdaten, Vertragsentwürfe oder interne Dokumente in ein unfreigegebenes KI-Tool eingibt, haben Sie kein Toolproblem mehr, sondern ein Governance-Problem.

Der Markt zeigt, wie schnell das Thema eskaliert. Im Jahr 2024 nutzten 71 Prozent der befragten deutschen Unternehmen Large Language Models, 44 Prozent davon konkret GPT-4.x. Diese Verbreitung zeigt, wie real das Risiko geworden ist, nicht wie theoretisch. Die Zahlen finden Sie in der Statista-Umfrage zur Quelle von Large Language Models in deutschen Unternehmen.

KI verbieten funktioniert nicht

Viele Unternehmen reagieren reflexhaft mit Verboten. Das ist ein Fehler. Mitarbeitende nutzen KI trotzdem, nur dann eben ohne Freigabe, ohne Schulung und ohne Protokollierung.

Sie brauchen also keinen Bann. Sie brauchen einen sicheren, freigegebenen Weg.

Das ist der Kern der Debatte um llm hosting deutschland. Sie schaffen einen offiziellen Kanal, über den Teams produktiv arbeiten können, ohne vertrauliche Daten unkontrolliert in Drittländer zu schieben. Damit holen Sie KI aus der Grauzone in den geregelten Betrieb.

Die richtige Frage

Fragen Sie nicht zuerst: Welches Modell ist am kreativsten?

Fragen Sie zuerst:

- Wo laufen die Anfragen tatsächlich

- Unter welchem Rechtsrahmen werden Daten verarbeitet

- Wer kann technisch und vertraglich auf Inhalte zugreifen

- Wie verhindern wir Wildwuchs im Unternehmen

Wenn Sie diese vier Fragen sauber beantworten, wird aus KI kein Risiko, sondern ein Werkzeug mit klaren Leitplanken.

Der entscheidende Unterschied zwischen Cloud-KI und echtem LLM-Hosting

Viele Anbieter werfen alles in einen Topf. Chatbot, API, SaaS-Tool, Copilot, private Instanz. Für den Einkauf klingt das ähnlich. Für Datenschutz und IT-Betrieb ist es etwas völlig anderes.

Black Box gegen gläserne Vitrine

Cloud-KI auf fremder Infrastruktur funktioniert wie ein Paket, das Sie in einen undurchsichtigen Container werfen. Sie wissen, dass es irgendwo ankommt. Sie sehen aber nicht sauber, welche Stationen es durchläuft, wer hineinschauen kann und welche Nebenbedingungen gelten.

LLM Hosting in Deutschland ist die gläserne Vitrine. Der Standort ist klar. Der Rechtsraum ist klar. Die Sicherheitsarchitektur ist prüfbar. Die Verantwortlichkeiten sind benennbar.

Das ist kein philosophischer Unterschied. Das ist der Unterschied zwischen Kontrollverlust und Steuerbarkeit.

Was Mittelständler oft unterschätzen

Mitarbeitende vergleichen keine Datenverarbeitungsverträge. Sie vergleichen Bequemlichkeit. Wenn das offizielle Unternehmensangebot langsam, umständlich oder gar nicht vorhanden ist, greifen Teams zum Tool, das in zwei Minuten einsatzbereit ist.

Dann passiert Folgendes:

- Vertrieb lädt Angebotsentwürfe hoch.

- HR formuliert Antworten auf Bewerbungen mit echten Personaldaten.

- Support verarbeitet Tickets mit Kundendetails.

- Recht testet Klauseln in externen Tools.

Jede einzelne Handlung wirkt harmlos. In Summe entsteht ein unkontrollierter Datenabfluss.

Sie können Schatten-IT nicht per Rundmail beenden. Sie beenden sie nur, wenn die sichere Alternative einfacher ist als der Umweg.

Der Serverstandort ist eine Managementfrage

Wer bei llm hosting deutschland nur an Rechenzentren denkt, greift zu kurz. Der Serverstandort entscheidet über Datensouveränität, Prüfpfade, Freigaben und Vertrauen.

Eine Bitkom-Umfrage aus dem Jahr 2025 zeigt laut dem verlinkten IONOS-Kontext, dass 62 Prozent der deutschen Unternehmen Risiken beim Datentransfer in Drittländer fürchten. Genau deshalb sind lokale Hosting-Modelle für viele Unternehmen keine Kür mehr, sondern Pflicht im Betrieb. Der Verweis steht im Umfeld des IONOS AI Model Hub.

Ein Vergleich aus einem anderen IT-Bereich

Die Diskussion kennen viele bereits aus der Kommunikationstechnologie. Auch dort reicht es nicht, nur Funktionen zu vergleichen. Man muss prüfen, wo Daten laufen, wie Verträge gestaltet sind und wie sauber sich das System in bestehende Prozesse einfügt. Wer das Thema strukturiert angehen will, findet im Cloud Telefonanlage Vergleich ein gutes Beispiel dafür, wie man Infrastrukturentscheidungen nicht nach Werbeversprechen, sondern nach Betriebsrealität bewertet.

Woran Sie echte Kontrolle erkennen

Ein belastbares Setup für llm hosting deutschland erkennen Sie nicht an schicken Oberflächen, sondern an klaren Antworten auf drei Punkte:

| Kriterium | Unsicheres Standard-Tool | Sauberes Hosting-Modell |

|---|---|---|

| Datenresidenz | unklar oder außerhalb der EU | vertraglich und technisch im EU-Rechtsraum |

| Nutzung im Unternehmen | individuell, unkontrolliert | zentral freigegeben und steuerbar |

| Governance | kaum prüfbar | Rollen, Richtlinien und Verantwortlichkeiten definiert |

Wenn Ihr Anbieter hier ausweicht, ist die Entscheidung bereits gefallen. Dann ist es nicht der richtige Anbieter.

Was DSGVO und Serverstandort wirklich bedeuten

Die DSGVO ist an dieser Stelle erstaunlich simpel. Wenn personenbezogene Daten in ein Drittland übermittelt werden, gelten zusätzliche Anforderungen. Bei KI ist genau das schnell der Fall, weil Eingaben, Metadaten und Verarbeitungswege oft nicht auf den ersten Blick sichtbar sind.

Was Art. 44 ff. DSGVO im Alltag heißt

Für Sie als Unternehmen bedeutet das keine juristische Vorlesung, sondern eine operative Vorgabe: Sie müssen wissen, wo Daten verarbeitet werden und auf welcher Rechtsgrundlage das passiert. Wenn der Anbieter oder ein Unterauftragnehmer außerhalb des europäischen Rechtsraums sitzt, wird es sofort komplizierter.

Darum ist der Serverstandort kein Detail aus der Technikabteilung. Er ist ein Compliance-Kriterium.

Was Sie vom Anbieter verlangen sollten

Ein DSGVO-tauglicher Anbieter muss mehr liefern als den Satz „Wir nehmen Datenschutz ernst“. Relevant sind belastbare technische und organisatorische Maßnahmen.

Dazu gehören insbesondere:

- EU-Hosting ohne Drittland-Übertragung. Das ist die Grundlage, wenn Sie personenbezogene Daten rechtssicher verarbeiten wollen.

- Verschlüsselung im Standardbetrieb. Laut den Angaben zu deutschen Hosting-Angeboten setzen DSGVO-konforme Anbieter typischerweise auf AES-256/TLS-Verschlüsselung und garantieren per EU-Hosting, dass keine Drittland-Übertragungen stattfinden. Das ist bei meinllm.de konkret beschrieben.

- Klare Aussage zur Datennutzung. Ihre Eingaben dürfen nicht nebenbei in unklare Trainings- oder Speicherprozesse rutschen.

- Prüfbare Rechenzentrumsstandards. ISO 27001 oder BSI C5 sind keine Dekoration, sondern Hinweise auf ein strukturiertes Sicherheitsniveau.

Zero Retention ist die entscheidende Rückfrage

Wenn Sie nur eine Sicherheitsfrage im Erstgespräch stellen, dann diese: Werden Prompts, Dateien und Antworten gespeichert oder zur Modellverbesserung genutzt?

Wenn die Antwort schwammig ist, hören Sie auf. Sie brauchen keine Produktdemo, sondern einen anderen Anbieter.

„Datenschutz in der KI beginnt nicht bei der Verschwiegenheit des Mitarbeiters, sondern bei der Architektur des Dienstes.“

So prüfen Sie Anbieter ohne Juristendeutsch

Gehen Sie pragmatisch vor. Diese Unterlagen und Aussagen sollten Sie anfordern oder nachlesen:

- Vertragliche Beschreibung der Datenverarbeitung

- Nachweis zum Hosting-Standort

- Informationen zu Verschlüsselung, Zugriffen und Löschkonzept

- Aussagen zur Protokollierung und Retention

- Subunternehmerliste

Wenn Sie eine saubere Orientierung suchen, lohnt außerdem ein Blick auf allgemeinen Datenschutzbestimmungen, einfach als Referenz dafür, wie transparente Anbieter ihre Grundsätze offenlegen. Für den KI-spezifischen Blick auf die Cloud-Perspektive ist auch der Beitrag zur DSGVO-konformen Cloud bei innoGPT nützlich.

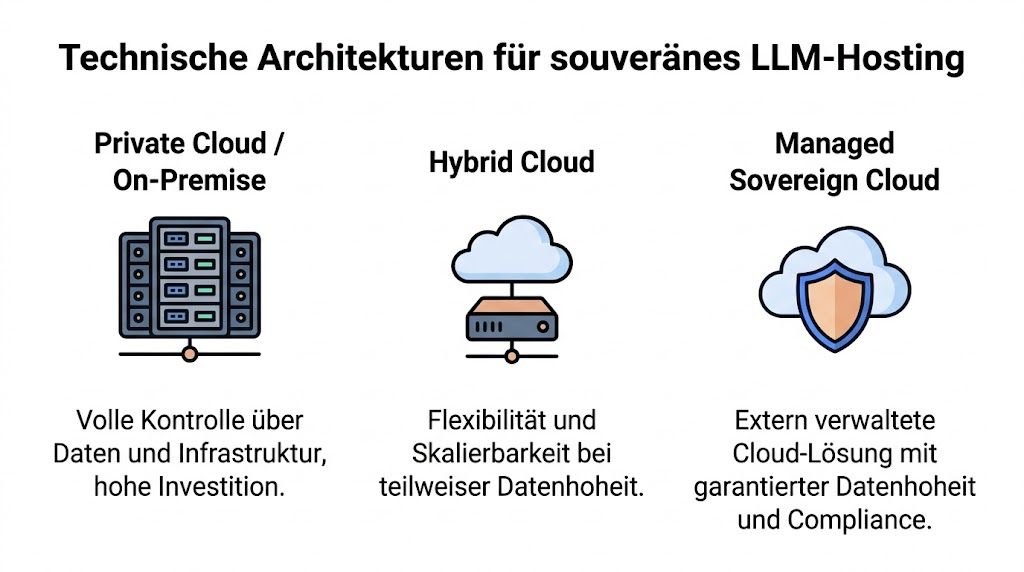

Technische Architekturen für souveränes LLM-Hosting

IT-Entscheider stehen meist vor drei realistischen Optionen. Eigene Infrastruktur. Eine hybride Architektur. Oder eine gemanagte souveräne Cloud bei einem deutschen oder europäischen Anbieter. Keine dieser Varianten ist pauschal richtig. Aber eine davon passt fast immer besser zu Ihrem Reifegrad als die anderen.

Private Cloud oder On-Premise

Das ist die konsequenteste Form von Kontrolle. Daten, Infrastruktur, Zugriffsregeln und Betriebsprozesse liegen vollständig in Ihrer Hand oder bei einem sehr eng geführten Hosting-Partner.

Das ist attraktiv, wenn Sie in einer regulierten Umgebung arbeiten, interne Security-Vorgaben streng sind oder besonders sensible Daten verarbeiten. Die Kehrseite ist klar: Sie brauchen Betriebskompetenz, klare Verantwortlichkeiten und einen belastbaren Supportprozess.

Typische Anforderungen in dieser Variante:

- Eigene Betriebsverantwortung für Updates, Monitoring und Incident-Handling

- Beschaffung und Kapazitätsplanung für GPU-Ressourcen

- Integration in Identitätsmanagement, DMS, Wissensdatenbanken und Freigabeprozesse

Für viele KMU ist das fachlich sinnvoll, organisatorisch aber zu schwer.

Hybrid-Architektur

Hybrid ist oft der vernünftigste Mittelweg. Sensible Dokumente, Wissensquellen oder RAG-Komponenten bleiben in Ihrer kontrollierten Umgebung. Der Modellzugriff oder bestimmte Services laufen in einer streng gesteuerten, europäischen Infrastruktur.

Das eignet sich, wenn Sie bereits Systeme wie SharePoint, Teams oder ein internes DMS haben und diese nicht aufbrechen wollen. Sie behalten wichtige Datenflüsse im Griff, ohne jede Schicht selbst betreiben zu müssen.

Hybrid verlangt allerdings Disziplin. Ohne klare Trennung zwischen Datenklassen, Nutzergruppen und Anwendungsfällen entsteht ein System, das auf dem Papier souverän aussieht, in der Praxis aber unnötig komplex wird.

Entscheidungshilfe: Wenn Ihre Fachbereiche schnell produktiv werden sollen, aber die Compliance-Abteilung bei Kernprozessen volle Kontrolle fordert, ist Hybrid meist der sinnvollste Startpunkt.

Managed Sovereign Cloud

Hier übernimmt ein spezialisierter Anbieter den technischen Unterbau. Sie erhalten einen dienstbereiten Zugang, definierte Sicherheitsmerkmale und geregelte Datenresidenz, ohne selbst GPU-Betrieb und MLOps aufbauen zu müssen.

Für den Mittelstand ist das häufig der pragmatischste Weg. Nicht weil es technisch am spannendsten wäre, sondern weil es die Lücke zwischen Governance und Geschwindigkeit schließt.

Die entscheidende Frage lautet dann nicht mehr „Können wir ein LLM betreiben?“, sondern „Können wir es sicher, nachvollziehbar und für Fachbereiche nutzbar bereitstellen?“

Leistungsfähigkeit ist kein Nebenthema

Viele Unternehmen glauben, lokales oder deutsches Hosting sei automatisch langsamer. Das stimmt so nicht. Dedizierte GPU-Server in deutschen Rechenzentren ermöglichen laut WZ-IT eine 30 bis 50 Prozent schnellere Inferenzzeit im Vergleich zu US-basierten Clouds, weil die physische Nähe zu den Endnutzern Netzwerkverzögerungen reduziert. Die Angabe finden Sie bei WZ-IT zum LLM-Hosting mit dedizierten GPU-Servern.

Für den Betrieb ist das relevant. Wenn Antworten spürbar schneller kommen, nutzen Teams die Plattform eher im Alltag. Wenn jede Anfrage zäh wirkt, wandern Mitarbeitende wieder zu unkontrollierten Tools ab.

Direkter Vergleich der drei Modelle

| Architektur | Kontrolle | Betriebsaufwand | Skalierung | Geeignet für |

|---|---|---|---|---|

| Private Cloud / On-Premise | sehr hoch | hoch | intern zu planen | stark regulierte oder sehr sicherheitskritische Umgebungen |

| Hybrid | hoch bei Kernsystemen | mittel bis hoch | flexibel | Unternehmen mit bestehender IT-Landschaft und differenzierten Datenklassen |

| Managed Sovereign Cloud | hoch bei guter Anbieterwahl | niedrig bis mittel | schnell nutzbar | KMU, die KI sauber einführen wollen ohne eigenes ML-Ops-Team |

Meine klare Empfehlung

Wenn Sie ein typisches deutsches KMU sind, starten Sie nicht mit On-Premise aus Prinzip. Starten Sie mit dem Modell, das Sie innerhalb kurzer Zeit kontrolliert produktiv bekommen.

In den meisten Fällen heißt das: Managed Sovereign Cloud oder ein Hybrid-Ansatz. On-Premise lohnt sich erst dann, wenn Ihr Sicherheitsprofil, Ihre Auslastung und Ihre internen Ressourcen diese Komplexität tatsächlich rechtfertigen.

Worauf es bei der Anbieterauswahl ankommt

Viele Anbieter verkaufen Sicherheit als Schlagwort. Sie brauchen stattdessen eine belastbare Einkaufsliste. Sonst zahlen Sie entweder für unnötige Infrastruktur oder kaufen ein Tool ein, das später an Datenschutz, Integration oder Governance scheitert.

Fünf Kriterien, die wirklich zählen

Erstens: Datenresidenz muss eindeutig sein. Wenn der Anbieter nicht klar benennt, ob Verarbeitung und Hosting in Deutschland oder wenigstens sauber im EU-Rechtsraum erfolgen, streichen Sie ihn.

Zweitens: Sicherheitsmaßnahmen müssen konkret sein. Fragen Sie nach Verschlüsselung, Rollenmodellen, Zugriffspfaden, Löschkonzepten und Rechenzentrumsstandards. Wollen Sie mit sensiblen Unternehmensdaten arbeiten, reichen Hochglanzfolien nicht.

Drittens: Modellvielfalt muss zu Ihrem Einsatz passen. Manche Teams brauchen proprietäre Modelle, andere bevorzugen Open-Source-Modelle. Entscheidend ist nicht die längste Modellliste, sondern ob Ihr Anbieter die Modelle bereitstellt, die zu Ihren Aufgaben und Compliance-Vorgaben passen.

Viertens: Integration schlägt Insellösung. Wenn das System nicht mit SharePoint, Teams, Google Drive, Slack oder Ihrem CRM zusammenspielt, produzieren Sie Reibung statt Produktivität.

Fünftens: Betriebsmodell und Support müssen realistisch sein. Wer ist zuständig, wenn Rechte falsch gesetzt sind, Antwortzeiten einbrechen oder ein Fachbereich neue Anforderungen hat? Ein Anbieter ohne belastbaren Betriebsprozess wird im Alltag zum Problem.

Kosten ohne Illusionen

Souveränes llm hosting deutschland ist kein Hobbyprojekt. Wer ein privates LLM-Deployment plant, muss die wirtschaftliche Seite sauber einordnen. Laut einem Leitfaden für deutsche KMU liegen die Kosten für private LLM-Deployments im Jahr 2026 je nach Modell und Setup zwischen 12.000 und 86.000 Euro Einmalkosten plus laufenden Monatskosten von 600 bis 9.800 Euro. Die Einordnung finden Sie bei LSI Analytics zum privaten LLM-Deployment für KMU in Deutschland.

Das ist keine Abschreckung. Das ist eine Entscheidungshilfe.

So lesen Sie Preislisten richtig

Achten Sie auf diese Punkte, bevor Sie vergleichen:

- Einmalaufwand. Enthält das Angebot nur Hosting oder auch Einrichtung, Zugriffssteuerung und Integration?

- Laufende Kosten. Zahlen Sie für feste Kapazität, für Nutzung oder für beides?

- Versteckte Betriebsarbeit. Müssen Ihre Admins später Konnektoren, Rollen oder Sicherheitsregeln selbst pflegen?

- Modellwechsel. Können Sie andere Modelle nutzen, ohne das ganze Setup neu aufzubauen?

Ein günstiger Einstiegspreis ist wertlos, wenn Sie danach mit jeder Anpassung in ein neues Projekt rutschen.

Fragen, die im Termin auf den Tisch müssen

Stellen Sie dem Anbieter diese Fragen direkt:

- Wo liegen unsere Daten technisch und vertraglich?

- Welche Modelle können wir freischalten und nach welchen Regeln?

- Wie sieht die Zugriffskontrolle für Fachbereiche, Admins und Datenschutz aus?

- Welche Integrationen sind produktiv verfügbar und welche nur auf der Roadmap?

- Was passiert mit Eingaben, Anhängen und Protokollen nach der Verarbeitung?

Wenn darauf nur Marketingantworten kommen, haben Sie Ihre Shortlist bereits verkleinert.

Die Abkürzung zu sicherem LLM-Hosting innoGPT

Montagmorgen, 8:30 Uhr. Der Vertrieb nutzt ein US-Tool für Angebotsentwürfe, HR lädt Richtlinien in einen freien KI-Chat, und die IT erfährt davon erst, als der Datenschutzbeauftragte nach den Verarbeitungswegen fragt. Genau so entsteht in vielen KMU kein Innovationsvorsprung, sondern ein Governance-Problem.

Der pragmatische Ausweg ist meist keine Eigenentwicklung, sondern eine Plattform, die Nutzung, Rechte und Datenflüsse zentral steuert. Für deutsche KMU zählt nicht technischer Stolz. Entscheidend ist, dass produktive KI-Nutzung schnell startet und unter Kontrolle bleibt.

Was eine gute Plattform leisten muss

Eine Unternehmensplattform für generative KI muss vier Dinge gleichzeitig beherrschen:

- Freigegebene Nutzung statt Schatten-IT. Mitarbeitende arbeiten in einem kontrollierten System statt mit Einzelaccounts bei fremden Tools.

- Weniger Betriebsaufwand. Ihre IT braucht kein eigenes Team für MLOps, GPU-Betrieb und Modellorchestrierung.

- Zentrale Steuerung von Modellen und Zugriffen. Fachbereiche bekommen passende Funktionen, ohne dass jede Abteilung eigene Lösungen beschafft.

- Anbindung an bestehende Systeme. Die Plattform muss in Microsoft 365, Wissensquellen und Identitätsverwaltung passen.

Fehlt einer dieser Punkte, entsteht nur ein weiterer KI-Chat. Für den Unternehmenseinsatz reicht das nicht.

Warum der Plattformansatz für KMU oft der richtige Weg ist

Viele Mittelständler unterschätzen, wie schnell aus einem LLM-Projekt ein Dauerprojekt wird. Erst kommt der Modellzugang. Dann folgen Rechtekonzepte, SSO, Protokollierung, Connectoren, Retention-Regeln und Abstimmungen mit Datenschutz, Betriebsrat und Fachbereichen. Wer das selbst baut, übernimmt auch den späteren Betrieb.

Eine Plattform wie eine zentrale KI-Plattform für Unternehmen verkürzt diesen Weg deutlich. innoGPT bündelt verschiedene Sprachmodelle in einer für den Unternehmenseinsatz ausgelegten Umgebung, unterstützt Integrationen etwa in SharePoint oder Teams und bringt Funktionen für Rollen, SSO und organisatorische Steuerung mit. Für viele KMU ist das der sinnvollste Mittelweg zwischen unsicheren Public-Tools und teurem Eigenbau.

Der geschäftliche Vorteil ist klar. Sie geben Ihren Teams einen nutzbaren Standard, ohne erst eine eigene KI-Infrastruktur als Nebenprodukt aufzubauen.

Für wen das besonders sinnvoll ist

Der Plattformansatz passt vor allem dann, wenn mehrere Bereiche gleichzeitig starten sollen und die Anforderungen auseinanderlaufen. Vertrieb will schneller formulieren. HR will mit internen Vorlagen arbeiten. Service braucht kontrollierte Antwortentwürfe. Compliance verlangt nachvollziehbare Regeln und klare Zuständigkeiten.

Genau hier scheitern Einzellösungen oft im Alltag. Im Pilot wirken sie schnell und günstig. Im Betrieb fehlen Steuerung, Zuständigkeiten und belastbare Prozesse.

Wer KI im Unternehmen einführt, braucht einen kontrollierten Zugang für Teams, nicht nur ein gutes Modell.

Meine Empfehlung aus Beratungssicht

Wenn Sie kein eigenes AI-Infrastrukturteam haben, bauen Sie keine Architektur, die Sie später selbst absichern und betreiben müssen. Führen Sie zuerst einen zentral verwalteten Standardzugang ein, mit klaren Rollen, sauberer Nutzerführung und verbindlichen Regeln für Daten und Freigaben.

So erreichen Sie Datensouveränität mit vertretbarem Aufwand. Für deutsche KMU ist das in der Praxis meistens der schnellste Weg zu sicherem, nutzbarem LLM-Einsatz.

Ihr Fahrplan zum DSGVO-konformen LLM-Einsatz

Wenn Sie das Thema jetzt sauber angehen wollen, brauchen Sie keinen Strategieworkshop über Monate. Sie brauchen einen klaren Start.

Der praktikable Weg für deutsche KMU

Schatten-IT sichtbar machen

Fragen Sie offen in Vertrieb, HR, Support, Marketing und Verwaltung nach, welche KI-Tools heute bereits genutzt werden. Nicht zur Sanktionierung, sondern zur Bestandsaufnahme.Datenklassen festlegen

Trennen Sie öffentliche Inhalte, interne Informationen, vertrauliche Geschäftsdaten und personenbezogene Daten. Erst dann können Sie Regeln für den KI-Einsatz definieren.Anwendungsfälle priorisieren

Starten Sie mit Aufgaben, die hohen Nutzen und beherrschbares Risiko verbinden. Typisch sind Texterstellung, Zusammenfassungen, interne Wissensabfragen und Antwortentwürfe.Anbieter nach Governance auswählen

Nicht die beste Demo gewinnt, sondern der Anbieter mit sauberer Datenresidenz, klarer Retention-Regel und brauchbaren Integrationen.Pilot mit echten Teams aufsetzen

Wählen Sie einen begrenzten Nutzerkreis. Geben Sie klare Richtlinien aus. Prüfen Sie Nutzung, Akzeptanz und Freigabeprozesse im Alltag.Regeln schriftlich verankern

Ihr Team braucht eine verständliche KI-Richtlinie. Kurz, praktisch, ohne Juristensprache. Jeder Mitarbeiter muss wissen, was erlaubt ist und was nicht.

Was Sie Ihrem Team sagen sollten

Sagen Sie nicht: „Benutzt keine KI.“

Sagen Sie: „Benutzt nur freigegebene KI-Systeme. Keine echten Personen- oder Kundendaten in unfreigegebene Tools. Für alles andere gibt es einen sicheren Unternehmenszugang.“

Das ist verständlich. Das ist durchsetzbar. Und das ist realistisch.

Wenn Sie prüfen möchten, wie sich ein sicherer KI-Zugang im Unternehmen praktisch anfühlt, testen Sie innoGPT selbst. Ohne Kreditkarte, ohne Risiko. So sehen Sie schnell, ob eine zentral gesteuerte, EU-gehostete Lösung zu Ihrem Unternehmen passt.

Lass dir innoGPT in 15 Minuten zeigen.

Wir nehmen uns gerne Zeit für dich!