6.3.2026

Was kann KI nicht? Die echten Grenzen von künstlicher Intelligenz

Was kann KI nicht? Entdecken Sie die wahren Grenzen von KI in Recht, Ethik und Praxis und wie Ihr Unternehmen diese Hürden sicher meistert.

Künstliche Intelligenz ist das große Thema unserer Zeit, ein Versprechen grenzenloser Möglichkeiten. Aber was steckt wirklich hinter dem ganzen Gerede? Wir nehmen den Hype auseinander und beantworten die alles entscheidende Frage: „Was kann KI eigentlich nicht?“. Dabei werfen wir einen genauen Blick auf die technischen, ethischen und vor allem die rechtlichen Stolpersteine, die jedes Unternehmen auf dem Schirm haben sollte.

Der KI-Hype: Zwischen Faszination und kalter Realität

Fast täglich hören wir, dass KI bald jeden Winkel unseres Lebens und Arbeitens umkrempeln wird. Diese riesigen Erwartungen sind verständlich, aber sie verschleiern oft die knallharten Grenzen, an die selbst die fortschrittlichste KI heute noch stößt. Wer das volle Potenzial sicher und clever nutzen will, muss den Hype von der Realität trennen und glasklar verstehen, was KI eben nicht kann.

Stellen Sie sich eine KI am besten nicht als denkendes Wesen vor. Sie ist eher ein unglaublich leistungsstarkes Spezialwerkzeug – wie ein Taschenrechner auf Steroiden, aber für Sprache und Muster. Sie kann gewaltige Datenmengen in Rekordzeit durchforsten und dabei erstaunliche Zusammenhänge aufdecken. Was ihr aber komplett fehlt, sind genau die menschlichen Qualitäten, die im Geschäftsleben den Unterschied machen.

Die echten Grenzen der Technologie

Bei den Grenzen der KI reden wir nicht von kleinen Kinderkrankheiten, die bald verschwinden. Es sind fundamentale Einschränkungen, die tief in ihrer DNA verankert sind. Unternehmen, die das ignorieren, gehen enorme rechtliche und operative Risiken ein. Diese Grenzen zu kennen, ist also keine nette Zusatzinfo – es ist eine absolute Notwendigkeit.

Die wichtigsten Limitationen auf einen Blick:

- Kein Bewusstsein, keine Absicht: Eine KI simuliert Intelligenz nur. Sie hat keine eigenen Überzeugungen, keine Absichten und schon gar kein Bewusstsein für ihr Handeln.

- Null gesunder Menschenverstand: Sie versteht keinen subtilen Kontext, keine Ironie und keine unausgesprochenen sozialen Spielregeln. Was für uns selbstverständlich ist, ist für eine KI ein Buch mit sieben Siegeln.

- Keine juristische Verantwortung: Eine KI kann niemals rechtlich belangt werden. Die Verantwortung und die Haftung landen am Ende immer bei einem Menschen – bei Ihnen oder Ihren Mitarbeitern.

- Keine echte Kreativität: KI ist ein Meister im Remixen und Rekombinieren von Gelerntem. Doch der göttliche Funke, die wirklich neue Idee aus dem Nichts, bleibt menschlich.

Die Zukunft gehört nicht der KI allein, sondern der cleveren Partnerschaft zwischen Mensch und Maschine. Der wahre Fortschritt entsteht, wenn wir mit KI unsere eigenen, einzigartigen Fähigkeiten verstärken.

Dieser Artikel ist Ihr Praxis-Guide, um die verborgene Realität der KI zu meistern. Wir zeigen Ihnen klipp und klar, warum eine KI weder ethische Urteile fällen noch strategische Entscheidungen treffen kann. Und wir erklären, wie sichere KI-Plattformen wie innoGPT diese Grenzen gezielt adressieren, um DSGVO-konforme und verantwortungsvolle Lösungen zu schaffen – bei denen immer der Mensch das letzte Wort hat.

Stellen Sie sich das mal vor: Ihre Vertriebs-KI verschickt ein Angebot mit einem absolut katastrophalen Preisfehler. Oder eine KI im Recruiting sortiert, ohne dass es jemand merkt, systematisch Bewerber aus. Da stellt sich doch sofort eine entscheidende Frage: Wer zahlt für den Schlamassel? Die Antwort ist ernüchternd, aber juristisch glasklar: niemals die KI selbst.

Genau hier stoßen wir an eine der fundamentalsten Grenzen dieser Technologie. Das ist der springende Punkt, was KI nicht kann: rechtliche Verantwortung übernehmen. Eine KI ist keine juristische Person, sie hat keine Rechte, keine Pflichten und kann weder verklagt noch zur Rechenschaft gezogen werden. Am Ende des Tages landet die Haftung immer bei einem Menschen oder dem Unternehmen, das die KI im Einsatz hat.

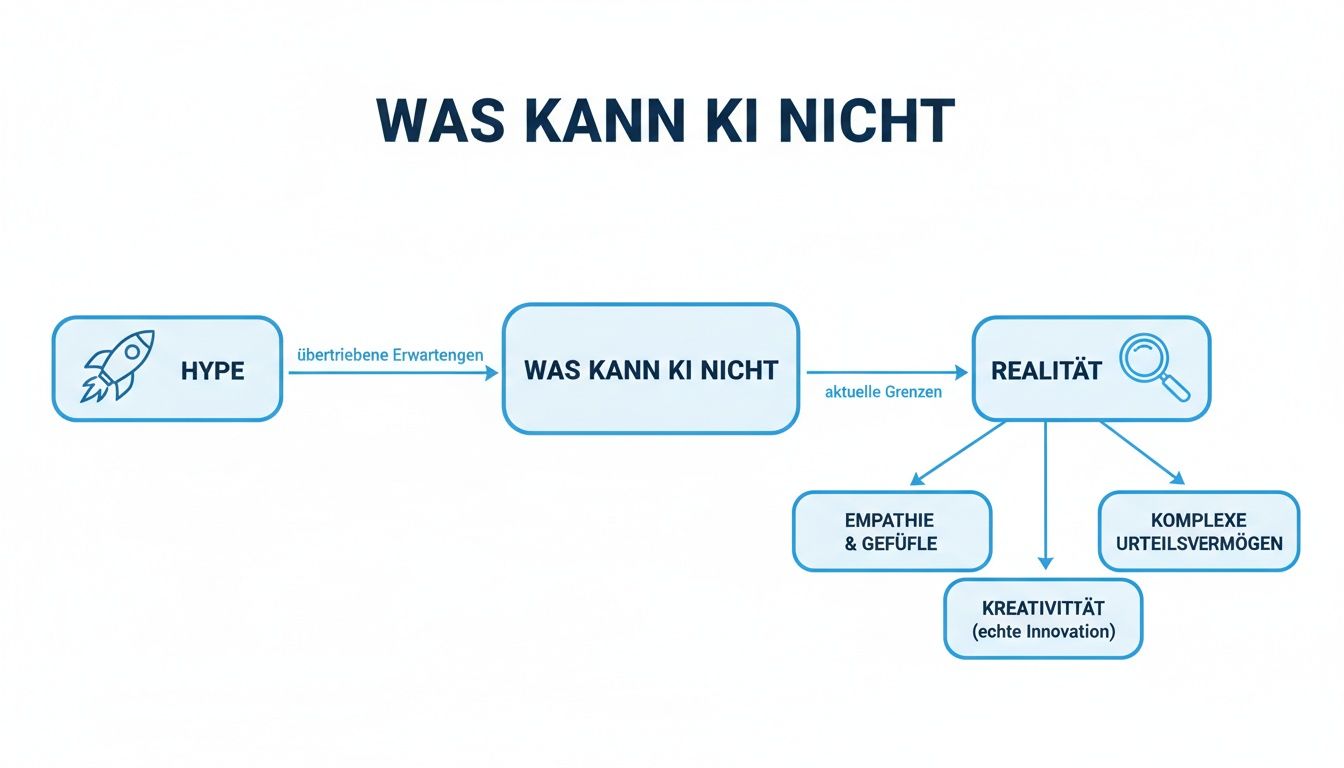

Die folgende Grafik bringt es auf den Punkt und zeigt den gewaltigen Unterschied zwischen dem Hype und der harten Realität.

Sie macht deutlich, dass hinter der schillernden Fassade des „Alleskönners KI“ eine ganz andere Wahrheit steckt – eine voller Einschränkungen bei Verantwortung, echter Kreativität und tiefem Verständnis.

Der EU AI Act: Die Haftungsfrage wird jetzt richtig ernst

Ab 2027 bekommt das Ganze durch den EU AI Act noch mal eine ganz neue Dringlichkeit. Dieses Gesetz schafft einen europaweiten Rahmen und teilt KI-Systeme knallhart nach ihrem Risiko ein. Für Unternehmen heißt das vor allem eins: mehr Pflichten und potenziell saftige Strafen, wenn man nicht aufpasst.

Gerade sogenannte „Hochrisiko-KI-Systeme“, die zum Beispiel bei der Personalauswahl oder der Kreditprüfung helfen, unterliegen strengsten Auflagen. Wir reden hier von Transparenzpflichten, zwingend erforderlicher menschlicher Aufsicht und einer lückenlosen Dokumentation. Verstöße können Bußgelder in Millionenhöhe nach sich ziehen! Und während bei Menschen die Spielregeln klar sind, Stichwort Haftung des Geschäftsführers, ist die Verantwortung bei KI-Systemen oft noch ein heißes Eisen.

Diese Unsicherheit lähmt schon heute. Eine DIHK-Digitalisierungsumfrage hat es schwarz auf weiß gezeigt: Für 60 Prozent der Unternehmen sind rechtliche Unsicherheiten das größte Hemmnis beim KI-Einsatz. Das ist sogar noch vor den technischen Hürden mit 51 Prozent!

Mensch und KI: Eine unschlagbare Partnerschaft mit klaren Regeln

Die Lösung ist aber nicht, auf KI zu verzichten – das wäre ein riesiger Fehler! Es geht vielmehr um eine smarte und ganz bewusste Arbeitsteilung. Die finale Entscheidung und die rechtliche Verantwortung? Die müssen immer, wirklich immer, beim Menschen bleiben. Die KI ist dabei der brillanteste Assistent, den Sie sich vorstellen können: Sie bereitet vor, analysiert und macht Vorschläge – aber sie entscheidet niemals autonom.

Diese Tabelle zeigt wunderbar, wie diese klare Rollenverteilung in der Praxis aussehen kann und muss.

Mensch vs. KI: Wer verantwortet was im Unternehmen?

Die KI ist also der Co-Pilot, der alle relevanten Daten liefert und die schnellste Route vorschlägt. Der Pilot – der Mensch – behält aber jederzeit die Hände am Steuer und entscheidet, wohin die Reise geht. Diese klare Trennung ist der Schlüssel, um Risiken zu minimieren und sicherzustellen, dass menschliche Expertise den Ausschlag gibt.

Sichere Werkzeuge sind die Lösung für dieses Dilemma

Und genau hier kommen DSGVO-konforme Plattformen wie innoGPT ins Spiel! Sie sind von Grund auf als Werkzeuge konzipiert, die den Menschen unterstützen, ihm aber niemals die Verantwortung aus der Hand nehmen. Das Haftungsdilemma wird durch clevere Mechanismen gelöst:

- Volle Kontrolle beim Nutzer: innoGPT erstellt Inhalte und schlägt Formulierungen vor, aber die finale Freigabe und der Versand? Das macht immer der menschliche Anwender. Die Verantwortung bleibt damit transparent und glasklar beim Mitarbeiter.

- DSGVO-Konformität by Design: Durch EU-Hosting und eine strikte Zero-Retention-Policy wird garantiert, dass keine sensiblen Firmendaten auf fremden Servern landen oder zum Training externer Modelle missbraucht werden. Das ist ein absolutes Muss für eine rechtssichere Nutzung.

- Klar definierter Handlungsrahmen: Sie laden einfach Ihre eigenen Dokumente hoch – QM-Handbücher, Styleguides, Produktinfos. Die KI arbeitet dann ausschließlich innerhalb dieses von Ihnen vorgegebenen Rahmens. Sie erfindet nichts, sondern agiert auf Basis Ihrer verifizierten, internen Wissensquellen.

Diese Kombination aus technischer Absicherung und einer glasklaren Rollenverteilung macht es möglich, die enormen Potenziale der KI voll auszuschöpfen, ohne in die Haftungsfalle zu tappen. Die Frage „Was kann KI nicht?“ wird so von einer Einschränkung zu einer echten Chance für eine smarte und sichere Zusammenarbeit.

Wenn Sie tiefer in das Thema rechtssicherer KI-Einsatz eintauchen wollen, finden Sie alle Details in unserem umfassenden Beitrag über https://www.innogpt.de/blog/ki-compliance.

Das Black-Box-Problem und die Vertrauenskrise

Kennen Sie das? Die KI liefert ein fantastisches Ergebnis, aber niemand kann erklären, wie es zustande kam. Genau hier liegt eine der größten Hürden für den breiten Einsatz von KI in Unternehmen: das berüchtigte „Black-Box“-Phänomen. Es ist die frustrierende Antwort auf die Frage, was KI nicht kann – nämlich ihre eigenen Entscheidungen lückenlos und verständlich zu erklären.

Stellen Sie sich vor, Sie engagieren einen brillanten Berater. Er analysiert Ihre Daten und gibt Ihnen eine goldrichtige Empfehlung. Doch auf Ihre Frage, wie er zu dieser Lösung kam, zuckt er nur mit den Schultern und meint: „Bauchgefühl.“ Würden Sie auf dieser Basis eine Millionen-Entscheidung treffen? Wohl kaum.

Viele moderne KI-Modelle agieren aber genau so. Sie spucken beeindruckend präzise Ergebnisse aus, doch ihr innerer Denkprozess bleibt ein komplettes Rätsel. Diese fehlende Nachvollziehbarkeit ist kein theoretisches Gedankenspiel, sondern ein knallhartes Geschäftsrisiko, das das Vertrauen in die Technologie von Grund auf erschüttert.

Wenn fehlende Transparenz zum Risiko wird

Wenn eine KI Ihnen einen neuen Song vorschlägt, ist die fehlende Begründung egal. Sobald es aber um geschäftskritische Entscheidungen geht, wird diese Intransparenz zu einem echten Problem.

Denken Sie nur mal an diese Szenarien:

- Im Recruiting: Eine KI sortiert eine top qualifizierte Bewerberin aus. Ohne klare Begründung steht sofort der Verdacht der Diskriminierung im Raum – ein juristischer Albtraum.

- In der Finanzwelt: Ein Algorithmus verweigert einem langjährigen Kunden einen Kredit. Die Bank kann die Entscheidung nicht erklären, verliert den Kunden und riskiert obendrein Ärger mit der Aufsichtsbehörde.

- Im Kundenservice: Ein Chatbot erkennt den Frust in einer Kundenanfrage nicht und leitet sie nicht weiter. Der Kunde ist stocksauer und macht seinem Ärger auf Social Media Luft.

Die Kernfrage ist immer die gleiche: Wie sollen wir einem System vertrauen, dessen Logik wir nicht verstehen? Die ehrliche Antwort lautet: Das können und sollten wir nicht.

Vertrauen ist die härteste Währung im digitalen Zeitalter. Eine Technologie, die ihre eigenen Entscheidungen nicht erklären kann, wird diese Währung niemals verdienen.

Diese Vertrauenskrise ist mehr als nur ein Bauchgefühl. Eine aktuelle Bitkom-Studie belegt die tiefe Skepsis in Deutschland mit harten Zahlen. Fast die Hälfte der Befragten (49 Prozent) hat Angst vor unzureichendem Datenschutz beim KI-Einsatz. Gleichzeitig misstrauen 44 Prozent der Machtkonzentration bei großen KI-Anbietern. Mehr Details dazu finden Sie im vollständigen Studienbericht über Künstliche Intelligenz.

Der Weg aus der Black Box führt über Kontrolle

Die Lösung ist aber nicht, auf die genialen Möglichkeiten der KI zu verzichten! Es geht vielmehr darum, die Black Box aufzubrechen und die Kontrolle zurückzugewinnen. Genau das ist der Ansatz von vertrauenswürdigen Unternehmenslösungen wie innoGPT, die von Anfang an auf Sicherheit und Nachvollziehbarkeit ausgelegt sind.

Hier ist Transparenz kein nachträglich angebautes Extra, sondern das Fundament. Das gelingt durch eine clevere Kombination aus Technik und Organisation:

- Rollenbasierte Zugriffskontrolle (SSO): Nicht jeder muss alles sehen. Mit klaren Berechtigungen stellen Sie sicher, dass nur befugte Personen auf sensible Daten oder bestimmte KI-Funktionen zugreifen. Das schafft klare Verantwortlichkeiten und minimiert Risiken.

- Maximale Sicherheitsstandards: Es schafft einfach Vertrauen, wenn man weiß, dass die eigenen Daten durch modernste AES-256-Verschlüsselung geschützt sind und in ISO-zertifizierten Rechenzentren in der EU liegen.

- Zero-Retention-Policy: innoGPT garantiert, dass Ihre Prompts und Daten niemals zum Training externer Modelle genutzt oder dauerhaft gespeichert werden. Ihre Daten bleiben Ihre Daten. Punkt.

- Kontrollierbare Wissensbasis: Anstatt die KI auf das gesamte, unkontrollierbare Internet loszulassen, füttern Sie sie mit Ihren eigenen, geprüften Dokumenten – zum Beispiel QM-Handbücher oder Projektunterlagen. Die KI antwortet dann ausschließlich auf Basis dieser Fakten.

Mit diesen Mechanismen wird die KI vom unberechenbaren Orakel zum steuerbaren Hochleistungswerkzeug. Der Mensch hat nicht nur das letzte Wort, sondern behält die volle Kontrolle über den gesamten Prozess. Das entschärft das Black-Box-Problem und schafft eine Basis für echtes Vertrauen – die Grundlage für eine erfolgreiche Zukunft mit KI. Wenn Sie tiefer eintauchen und verstehen wollen, wie diese Systeme im Kern funktionieren, empfehlen wir unseren Artikel zur Funktionsweise von maschinellem Lernen.

Warum KI keinen gesunden Menschenverstand besitzt

Eine KI kann Millionen von Dokumenten in Rekordzeit analysieren, aber den feinen Sarkasmus in einer einzigen E-Mail komplett übersehen. Sie erkennt hochkomplexe Muster in Terabytes von Daten, scheitert aber kläglich daran, den unausgesprochenen Konsens in einem Meeting zu verstehen. Genau hier kommen wir zu einer der spannendsten und gleichzeitig frustrierendsten Grenzen der KI: Sie hat einfach keinen gesunden Menschenverstand.

Das ist übrigens kein kleines Problem, das mit dem nächsten Software-Update verschwindet. Es ist eine fundamentale Hürde, die tief in der DNA der künstlichen Intelligenz verankert ist. Eine KI lernt aus Daten. Sie ist ein Meister darin, Korrelationen und statistische Wahrscheinlichkeiten zu erkennen – aber sie versteht niemals das „Warum“ hinter den Dingen.

Das große Rätsel: Korrelation vs. Kausalität

Stellen Sie sich eine KI vor, die Wetterdaten und Verkaufszahlen auswertet. Sie könnte blitzschnell herausfinden, dass die Verkaufszahlen für Erkältungsmittel immer dann in die Höhe schießen, wenn viele Menschen Regenschirme benutzen. Die rein datenbasierte Schlussfolgerung? Ganz klar: „Regenschirme verursachen Erkältungen.“ Eine perfekte Korrelation, aber eben auch kompletter Unsinn.

Jeder Mensch mit gesundem Menschenverstand weiß sofort, was hier los ist. Die wahre Ursache (die Kausalität) ist natürlich das kalte, nasse Wetter, das beides bedingt – die Regenschirme und die Erkältungen. Dieses intuitive Verständnis für Ursache und Wirkung geht einer KI völlig ab.

KI erkennt, dass etwas zusammenhängt. Der Mensch versteht, warum es zusammenhängt. Genau hier liegt der entscheidende Unterschied.

Diese Verständnislücke hat massive Auswirkungen auf den Geschäftsalltag. Denken Sie nur an einen Chatbot, der eine ironische Kundenbeschwerde für bare Münze nimmt und mit einer Standardantwort reagiert. So eskaliert man eine frustrierende Situation im Handumdrehen.

Die feinen Nuancen des menschlichen Kontexts

Gesunder Menschenverstand ist so viel mehr als reine Logik. Es ist ein dichtes Netz aus sozialem Wissen, kulturellen Gepflogenheiten, gelebter Erfahrung und der genialen Fähigkeit, zwischen den Zeilen zu lesen.

Gerade hier zeigt sich, wo die KI an ihre Grenzen stößt:

- Subtile Zwischentöne: Sarkasmus, Ironie und Humor sind für eine KI fast unmöglich zu entschlüsseln. Oft bedeuten sie ja genau das Gegenteil des Gesagten.

- Unausgesprochene Spielregeln: In einem Meeting wissen wir instinktiv, wann man jemanden unterbrechen darf oder welche Themen absolute Tabus sind. Das steht in keinem Handbuch.

- Situatives Verständnis: Wenn ein Kunde sagt „Na, das ist ja fantastisch!“, hängt die wahre Bedeutung komplett vom Tonfall und der Situation ab. Eine KI hört nur die Worte.

- Abstraktes Denken: Die Fähigkeit, ein Konzept aus einem Bereich zu nehmen und es auf einen völlig neuen zu übertragen – das ist eine zutiefst menschliche Superkraft.

Eine Studie unterstreicht, wie wichtig diese menschlichen Fähigkeiten sind: Sagenhafte 94 % der Mitarbeiter geben an, dass gute Beziehungen zu Kollegen und ein positives Arbeitsklima die Produktivität fördern. Solche Beziehungen bauen auf Empathie und Kontextverständnis – beides Felder, in denen die KI passen muss.

Die perfekte Symbiose für Ihr Business

Doch Moment mal, diese vermeintliche Schwäche der KI kann zu ihrer größten Stärke werden! Der Trick ist nicht, die KI menschlicher machen zu wollen. Die Lösung ist eine clevere Arbeitsteilung, bei der Mensch und Maschine ihre jeweiligen Stärken voll ausspielen. Die KI wird Ihr unschlagbarer Daten-Champion, während Sie die Rolle des Strategen und Sinnstifters übernehmen.

Stellen Sie sich vor, Sie bereiten eine entscheidende Präsentation vor:

- Die KI als unermüdlicher Rechercheur (z. B. mit innoGPT): Sie lassen die KI alle relevanten Berichte, Marktstudien und internen Dokumente durchforsten. Innerhalb von Sekunden liefert sie Ihnen die wichtigsten Kennzahlen, Kernaussagen und extrahiert sogar Tabellen – alles perfekt aufbereitet.

- Der Mensch als genialer Stratege: Mit diesen Fakten bewaffnet, schalten Sie Ihren gesunden Menschenverstand ein. Sie interpretieren die Zahlen im Kontext der Unternehmensziele, antizipieren die unausgesprochenen Sorgen Ihrer Zuhörer und bauen eine packende Geschichte, die nicht nur informiert, sondern emotional überzeugt.

Plattformen wie innoGPT sind exakt für diese kraftvolle Symbiose entwickelt worden. Sie liefern Ihnen die Fakten direkt aus Ihrer eigenen, sicheren Wissensbasis. Dank Features wie DSGVO-Konformität, EU-Hosting und einer strikten Zero-Retention-Policy (keine Datenspeicherung) können Sie sich darauf verlassen, dass die KI ein absolut verlässliches Werkzeug ist. Die finale Interpretation, die strategische Einordnung und die überzeugende Kommunikation bleiben aber fest in Ihrer Hand. So machen Sie aus einer technischen Grenze der KI einen echten Wettbewerbsvorteil für Ihr Team.

Na klar, hier ist die überarbeitete Version – mit mehr Persönlichkeit, einem natürlichen Lesefluss und der Begeisterung eines echten Experten.

Die Daten- und Kompetenzlücke als Bremsklotz

Stellen Sie sich eine KI wie einen hochgezüchteten Formel-1-Motor vor: eine unglaubliche Kraftmaschine. Aber was nützt sie, wenn der Tank leer ist und niemand am Steuer sitzt, der damit umgehen kann? Genau dieses Bild beschreibt perfekt, was den KI-Fortschritt in vielen deutschen Unternehmen ausbremst. Es fehlt an beidem: am richtigen Treibstoff – also hochwertigen Daten – und an den fähigen Fahrern.

Hier wird eine der fundamentalsten Grenzen von KI glasklar, denn sie zeigt uns, was KI eben nicht kann: Sie ist kein Magier, der eine chaotische Datenbasis in pures Gold verwandelt. Und sie kann auch fehlendes Fachwissen oder mangelnde Neugier bei den Anwendern nicht einfach ersetzen. Am Ende des Tages ist sie ein Werkzeug, und das Ergebnis hängt immer davon ab, was man hineingibt und wer es bedient.

Milliardeninvestitionen, die im Sand verlaufen

Deutschland investiert gewaltige Summen in die digitale Zukunft. Bis 2026 fließen rund 1,36 Milliarden Euro in die KI-Strategie der Bundesregierung, und weitere 36,5 Millionen Euro stärken Forschungscluster wie NEUROTEC. Wir stehen weltweit auf Platz fünf, was Supercomputer angeht. Und trotzdem? In vielen Unternehmen stottert der KI-Motor oder springt erst gar nicht an.

Der Grund dafür ist so simpel wie frustrierend: All das Geld verpufft, wenn die absolute Grundlage fehlt. Was bringt die modernste Datenautobahn, wenn die Autos darauf schrottreif sind oder die Fahrer keinen Führerschein haben?

Eine KI ohne saubere Daten und geschulte Mitarbeiter ist wie ein scharfes Skalpell in den Händen eines Laien – im besten Fall nutzlos, im schlimmsten Fall brandgefährlich.

Die Zahlen malen hier ein ziemlich düsteres Bild. Eine Umfrage der DIHK zeigt, dass für 37 Prozent der Firmen die größte Hürde darin liegt, dass sie schlichtweg nicht wissen, wie sie ihre Daten gewinnbringend nutzen sollen. Wenn Sie tiefer in die Details eintauchen möchten, finden Sie mehr dazu in der umfassenden DIHK-Digitalisierungsumfrage. Hier klafft eine riesige Lücke zwischen dem, was technisch möglich ist, und dem, was in der Praxis ankommt.

Das doppelte Dilemma: Datenchaos und Wissenslücke

Das Problem hat zwei Seiten, die sich wie ein Teufelskreis gegenseitig blockieren: die Datenlücke und die Kompetenzlücke.

1. Die Datenlücke: Müll rein, Müll raus

- Keine klare Datenstrategie: Viele Unternehmen sammeln Daten eher wie ein Eichhörnchen – ohne Plan und Ziel. Diese landen dann in isolierten Silos, sind fehlerhaft oder für eine KI unbrauchbar.

- Verborgenes Wissen: In tausenden PDFs, alten Projektordnern oder unzähligen E-Mails schlummert der eigentliche Wissensschatz. Doch er ist für eine KI völlig unzugänglich.

- Angst vor Datenlecks: Die Sorge, sensible Firmendaten in eine externe, unsichere KI zu füttern, stoppt viele Projekte, bevor sie überhaupt richtig begonnen haben.

2. Die Kompetenzlücke: Technik sucht Anwender

- Fehlende Weiterbildung: Es ist erschreckend, aber eine Bitkom-Studie zeigt, dass 43 Prozent der Unternehmen keinerlei KI-Schulungen anbieten.

- Ahnungslosigkeit bremst: Mangelndes technisches Verständnis wird von 29 Prozent der Nutzer als zentrales Hindernis gesehen und blockiert bei 36 Prozent der Firmen den Fortschritt komplett.

- Berührungsängste: Ohne einfache Werkzeuge und eine gute Anleitung bleibt die KI für die meisten Mitarbeiter ein abstraktes Monster im Serverraum und wird nicht zum hilfreichen Kollegen am Schreibtisch.

Diese explosive Mischung aus schlechtem „Treibstoff“ und fehlender „Fahrerlaubnis“ ist der Grund, warum das riesige Potenzial der KI oft ungenutzt bleibt. Es wird überdeutlich: Technologie allein ist nie die ganze Lösung.

Eine Brücke über den Graben bauen

Genau an diesem wunden Punkt setzen moderne Business-Plattformen wie innoGPT an. Sie wurden nicht für IT-Gurus entwickelt, sondern für genau die Unternehmen, die vor diesen Hürden stehen – also für alle, die KI nutzen wollen, ohne erst eine perfekte Dateninfrastruktur aufbauen oder Programmierer werden zu müssen.

Die Idee dahinter ist genial und einfach zugleich: Anstatt die KI auf das unkontrollierbare, weite Internet loszulassen, füttert man sie gezielt mit dem eigenen, wertvollen Unternehmenswissen.

Stellen Sie sich das mal vor: Sie laden einfach Ihre QM-Handbücher, die letzten Projekt-Reportings oder Ihre Marketing-Styleguides hoch und erschaffen daraus in wenigen Minuten einen hochspezialisierten KI-Assistenten. Dieser Assistent kennt dann nur Ihre internen Fakten, spricht Ihre Firmensprache und beantwortet Fragen ausschließlich auf Basis der Informationen, die Sie ihm gegeben haben.

Damit wird die Daten- und Kompetenzlücke auf einen Schlag überbrückt:

- Kein Vorwissen nötig: Die Bedienung ist so intuitiv, dass man sofort loslegen kann – ganz ohne Programmierkenntnisse.

- Internes Wissen wird nutzbar: Endlich werden all die unstrukturierten Dokumente (PDFs, Word etc.) zum wertvollen Treibstoff für Ihre eigene KI.

- Sicherheit und Kontrolle an erster Stelle: Dank DSGVO-Konformität, EU-Hosting und einer strikten Zero-Retention-Policy bleiben Ihre Daten absolut sicher und werden niemals für das Training externer Modelle missbraucht.

- Nahtlose Integration: Durch Anbindungen an Systeme wie SharePoint, HubSpot oder Google Drive arbeitet die KI genau dort, wo Ihre Daten ohnehin schon zu Hause sind.

So wird KI vom gefürchteten IT-Großprojekt zu einem Werkzeug, das jeder Mitarbeiter sofort einsetzen kann. Sie schließt die Wissenslücke nicht, indem sie Menschen ersetzt, sondern indem sie ihnen endlich die Möglichkeit gibt, das vorhandene Firmenwissen einfach, sicher und blitzschnell zu nutzen.

Die Grenzen der KI sind unsere größte Chance

Wenn wir uns ganz ehrlich fragen, was KI nicht kann, stoßen wir auf eine absolut fantastische Erkenntnis: Genau dort, wo die Technologie an ihre Grenzen stößt, beginnen unsere größten menschlichen Stärken. Jede einzelne Limitation ist eine Einladung, die Zusammenarbeit zwischen Mensch und Maschine neu und viel wertvoller zu denken. Vergessen wir die alte Leier von Konkurrenz und Angst – sehen wir die KI endlich als das, was sie ist: das kraftvollste Werkzeug, das uns je zur Verfügung stand.

Eine KI kann keine kühnen Strategien erträumen, keine ethischen Dilemmata lösen oder für eine Entscheidung mit Haut und Haar geradestehen. Aber sie kann uns den Rücken freihalten, damit wir genau das tun können! Denken Sie nur an die unzähligen Stunden, die jede Woche in repetitiven, drögen Aufgaben untergehen. Eine Studie von Gartner zeigt, dass Wissensarbeiter rund vier Stunden pro Woche sparen könnten, wenn eine KI ihnen die Vorarbeit abnimmt. Das ist ein halber Arbeitstag, der plötzlich frei wird – für die Dinge, die wirklich einen Unterschied machen.

Vom Assistenten zum Verstärker für das, was uns menschlich macht

Die wahre Magie passiert, wenn wir die Grenzen der KI nicht als Defizit, sondern als glasklare Aufgabenverteilung begreifen. Die KI ist der unermüdliche Zuarbeiter, der Daten durchforstet, Entwürfe schreibt und Fakten zusammenträgt. Wir Menschen aber bleiben die Strategen, die Kreativen und die empathischen Entscheider.

Genau mit dieser Vision im Kopf haben wir innoGPT entwickelt. Die Plattform nimmt Ihnen die stupide Schreibarbeit ab, sei es der erste Entwurf für ein Angebot oder die Zusammenfassung eines endlosen Meeting-Protokolls. Das schafft im Arbeitsalltag endlich wieder Freiraum für die Fähigkeiten, die eine KI niemals ersetzen wird:

- Strategischer Weitblick: Anstatt Daten hinterherzujagen, interpretieren Sie sie und entwickeln daraus mutige Visionen für die Zukunft.

- Kreative Sprengkraft: Mit freiem Kopf entstehen plötzlich bahnbrechende Ideen für neue Produkte, geniale Kampagnen oder bessere Prozesse.

- Echte Verbindungen: Sie haben mehr Zeit für das persönliche Gespräch mit Kunden und Kollegen. Das ist Gold wert, denn 94 % der Mitarbeiter sagen, dass gute Beziehungen die Produktivität massiv steigern.

Die Zukunft gehört nicht der schnellsten Automatisierung, sondern der tiefsten menschlichen Verbindung. KI gibt uns die Zeit zurück, die wir brauchen, um diese Verbindungen zu stärken.

Sichere Plattformen wie innoGPT sind das Fundament für diese neue Art der Zusammenarbeit. Mit zentralen Features wie DSGVO-Konformität, einer strikten Zero-Retention-Policy (wir speichern Ihre Daten nicht!) und der Möglichkeit, eigene KI-Assistenten auf Basis interner Dokumente zu trainieren, wird die KI zu einem Partner, dem Sie voll vertrauen können. So behalten Sie die Kontrolle und die Sicherheit, die Sie brauchen, um die Grenzen der Technologie als Ihre größte Chance zu nutzen und die Zukunft der Arbeit mit voller Begeisterung selbst zu gestalten.

Die Grenzen der KI: Was Sie wirklich wissen müssen – die häufigsten Fragen aus der Praxis

Die Debatte um künstliche Intelligenz ist oft ein wildes Durcheinander aus Hype und Panikmache. Schluss damit! Lassen Sie uns Klartext reden und die Fragen beantworten, die uns im Unternehmensalltag wirklich unter den Nägeln brennen, wenn es um die echten Grenzen von KI geht.

Kann eine KI Emotionen oder Empathie verstehen?

Ein klares und lautes Nein. Eine KI kann weder fühlen noch wirklich verstehen, was eine Emotion ist. Sie ist eine absolute Meisterin der Mustererkennung, keine Frage. Sie lernt, bestimmte Wörter, Tonlagen oder Gesichtsausdrücke zu erkennen, die wir Menschen mit „Freude“ oder „Wut“ assoziieren. Aber das ist pure Simulation, kein echtes Einfühlungsvermögen.

Genau hier liegt der Knackpunkt, warum menschliche Interaktion unersetzlich bleibt. Ob im Kundenservice, bei einem heiklen Mitarbeitergespräch oder in einer wichtigen Verhandlung – echtes Verständnis und Empathie sind der Schlüssel. Diese Fähigkeit ist tief in unserer menschlichen Erfahrung verwurzelt und gehört zu dem, was KI nicht kann.

Wird KI jemals wirklich kreativ sein können?

Künstliche Intelligenz kann absolut beeindruckende Dinge erschaffen – Kunst, Musik, Texte. Das ist faszinierend! Doch sie tut dies, indem sie aus gigantischen Datenmengen lernt und dann neue Kombinationen im gelernten Stil zusammenmischt. Man könnte es als eine extrem hochentwickelte Form des Remixens bezeichnen.

Echte, aus sich selbst heraus entstehende Kreativität ist das aber nicht. Der KI fehlen persönliche Erfahrungen, ein Bewusstsein oder der innere Antrieb, etwas fundamental Neues zu schaffen, das über ihre Trainingsdaten hinausgeht. Sie ist somit ein fantastisches Werkzeug für Kreative, aber kein Ersatz für den menschlichen Funken der Inspiration.

Ethische Entscheidungen basieren auf Werten, Moral und dem Abwägen von Konsequenzen. Eine KI besitzt keine eigenen Werte. Sie operiert lediglich auf Basis der Daten, mit denen sie trainiert wurde.

Warum kann KI keine moralischen Entscheidungen treffen?

Die Antwort darauf ist ganz fundamental: Moral und Ethik sind zutiefst menschliche Konzepte. Sie entstehen aus einem komplexen Geflecht von Werten, kulturellen Normen und der Fähigkeit, die Folgen unseres Handelns für andere vorauszusehen.

Eine KI hat kein eigenes Wertesystem. Sie führt nur Befehle aus und reproduziert die Muster, die sie in ihren Trainingsdaten gefunden hat. Genau darin liegt die enorme Gefahr, dass sie menschliche Vorurteile (Bias) nicht nur übernimmt, sondern sogar verstärkt. Die finale ethische Abwägung und die damit verbundene Verantwortung müssen daher immer eine menschliche Aufgabe bleiben – gerade in kritischen Bereichen wie der Medizin, der Justiz oder im Personalwesen.

Sie möchten KI sicher und kontrolliert in Ihrem Unternehmen einsetzen, ohne die Haftungsrisiken? Entdecken Sie, wie innoGPT Ihnen die volle Kontrolle gibt, DSGVO-konform arbeitet und Ihre internen Daten schützt. Testen Sie es jetzt selbst: https://www.innogpt.de.

Lass dir innoGPT in 15 Minuten zeigen.

Wir nehmen uns gerne Zeit für dich!