15.4.2026

Coding KI: Sicherer Code für europäische Unternehmen

Nutzen Sie Coding KI sicher im Unternehmen. Unser Guide erklärt, wie europäische Teams DSGVO-konform mit KI-Tools arbeiten, ohne Daten zu riskieren.

Ein Entwickler, der seinen proprietären Code in eine US-Coding-KI einspeist, ist wie ein Architekt, der seine Blaupausen zur Optimierung in ein Copyshop im Ausland schickt und hofft, dass niemand einen Blick drauf wirft. Genau so arbeiten heute noch erstaunlich viele Teams.

tl;dr:

- Coding KI bringt Tempo, aber nur dann sicher, wenn Teams proprietären Code, Architekturwissen und interne Doku nicht unkontrolliert an externe Dienste schicken.

- Reines Verbieten funktioniert nicht. Wenn offizielle Tools fehlen, entsteht Schatten-IT. Dann verliert die Organisation erst recht die Kontrolle.

- Der praktikable Weg für europäische Unternehmen ist eine Plattformstrategie mit klaren Regeln, EU-Hosting, Auftragsverarbeitung und technischem Schutz für generative Coding-Workflows.

Der blinde Fleck vieler Teams Das DSGVO-Risiko bei US-Coding-KIs

Viele Diskussionen über coding ki drehen sich um Geschwindigkeit. Das ist zu kurz gedacht. Das eigentliche Problem ist Kontrollverlust.

Sobald ein Entwickler internen Code, Stacktraces, Architekturdiagramme, Kundennamen oder Auszüge aus Tickets in ein externes KI-Tool kopiert, geht es nicht mehr nur um Komfort. Dann reden wir über geistiges Eigentum, Geschäftsgeheimnisse und unter Umständen auch über personenbezogene Daten.

Was aus technischer Sicht wirklich das Risiko ist

Im Alltag landen in Prompts selten nur harmlose Beispiele. Es sind oft genau die sensiblen Dinge, die ein Modell besonders nützlich machen.

- Repository-Kontext: Klassen, Interfaces, Namenskonventionen, interne Bibliotheken

- Architekturwissen: Service-Grenzen, Datenflüsse, Berechtigungslogik

- Produktlogik: Regeln, die den eigentlichen Unternehmenswert ausmachen

- Fehlerdaten: Logs, Exceptions, Testdaten, Supportfälle

Das Problem ist nicht, dass Entwickler fahrlässig wären. Das Problem ist, dass gute Prompts fast immer mehr Kontext brauchen. Je hilfreicher die KI sein soll, desto mehr verrät man ihr.

Praktische Regel: Wenn ein Prompt einem neuen Freelancer unter NDA nicht gezeigt werden dürfte, gehört er auch nicht ungeprüft in eine öffentliche oder US-basierte Coding-KI.

DSGVO ohne Juristenjargon

Für europäische Teams sind zwei Punkte zentral. Art. 28 DSGVO regelt vereinfacht gesagt, dass ein Dienstleister, der Daten im Auftrag verarbeitet, vertraglich sauber eingebunden sein muss. Und bei Datentransfers in Drittstaaten reicht es nicht, einfach zu hoffen, dass schon alles passt.

Für Entwickler heisst das praktisch:

| Frage | Warum sie zählt |

|---|---|

| Wo laufen die Anfragen? | Weil der Ausführungsort entscheidet, welche rechtlichen und technischen Schutzmechanismen gelten |

| Werden Inhalte für Modelltraining genutzt? | Weil aus Arbeitsdaten sonst Trainingsmaterial wird |

| Gibt es klare Auftragsverarbeitung? | Weil Compliance ohne saubere vertragliche Grundlage wackelt |

| Kann man Nutzung technisch begrenzen? | Weil Richtlinien ohne Kontrolle im Alltag schnell verpuffen |

Teams, die das ernst nehmen, prüfen heute auch lokale KI-Modelle für sensible Anwendungsfälle. Nicht, weil jedes Modell lokal laufen muss. Sondern weil Datenklassifizierung und Ausführungsort zusammen gedacht werden müssen.

Produktivität nützt nichts, wenn die Architektur leidet

Ein zweiter blinder Fleck sitzt im Code selbst. Der unkontrollierte Einsatz von Coding KI führt in deutschen Softwareteams laut Mindtwo zur architektonischen Inkonsistenz und zu erhöhten Sicherheitsrisiken. Dort wird auch auf eine CodeSignal-Umfrage verwiesen, nach der mehr als 50 Prozent der Entwickler sinkende Codequalität erwarten. Zudem wird eine um 15 bis 25 Prozent höhere Häufigkeit von Schwachstellen wie SQL-Injections in KI-generiertem Code beschrieben.

Das passt exakt zu dem, was man in Reviews sieht. Die KI löst oft die lokale Aufgabe ordentlich, aber sie kennt den Systemzusammenhang nicht zuverlässig. Das Resultat sind doppelte Patterns, inkonsistente Fehlerbehandlung und Code, der im Pull Request sauber aussieht, aber die Architektur langsam zerreibt.

Wer coding ki nur als Schreibbeschleuniger betrachtet, unterschätzt also zwei Dinge gleichzeitig. Den rechtlichen Fussabdruck und die technische Erosion.

Mehr als nur Code-Vervollständigung Was generative Coding KI kann

Viele setzen coding ki gedanklich noch mit Autocomplete gleich. Das trifft den Kern nicht mehr. Gute Systeme ergänzen nicht nur eine Zeile. Sie erzeugen zusammenhängende Artefakte.

Sie schreiben Funktionen, erzeugen Tests, formulieren Commit-Messages, bauen API-Beschreibungen und übersetzen Anforderungen in lauffähige Grundgerüste. Genau darin liegt ihr Wert.

Was diese Systeme konkret erzeugen

Im Alltag sind das typischerweise fünf Arten von Output:

- Funktionen und Module: etwa ein Validierungsservice, ein Parser oder ein kleines CLI-Tool

- Boilerplate-Code: DTOs, Mapper, Formulare, Routing, Konfiguration

- Unit-Tests: inklusive Edge Cases, Mocks und Fehlerpfade

- Dokumentation: README-Abschnitte, Inline-Kommentare, Changelogs, API-Beschreibungen

- Entwicklungsartefakte: Commit-Messages, Pull-Request-Zusammenfassungen, Migrationshinweise

Der Unterschied zu Analyse-Tools ist wichtig. Hier geht es nicht um Dashboards, Reporting oder Datenauswertung. Es geht um Erzeugung. Die KI produziert Text, Strukturen und Code, die vorher nicht existiert haben.

Wo die Qualität steht und wo Misstrauen berechtigt ist

Die Verbreitung ist längst real. Laut der McKinsey Global Survey on AI 2024, zusammengefasst von kibegleiter.de, nutzen 72 % der Unternehmen weltweit bereits KI-Anwendungen. Gleichzeitig zeigt die dort zitierte DORA-Studie, dass 30 % der Entwickler wenig Vertrauen in KI-generierten Code haben.

Dieses Misstrauen ist nicht rückständig. Es ist professionell.

Gute Teams behandeln generativen Output wie einen schnellen ersten Entwurf. Nicht wie Wahrheit mit Syntax-Highlighting.

Aus Senior-Sicht gilt eine einfache Faustregel. Lass die KI alles erzeugen, was klar prüfbar ist. Sei vorsichtig bei allem, was tief in Domänenlogik, Sicherheit, Berechtigungen oder verteilte Systeme eingreift.

Was in der Praxis gut funktioniert

Besonders stark ist coding ki bei Aufgaben mit erkennbarem Muster und klarer Zielstruktur.

| Gut geeignet | Kritisch prüfen |

|---|---|

| CRUD-Grundgerüste | Autorisierung und Rollenlogik |

| Testgerüste | Nebenläufigkeit und Race Conditions |

| API-Wrapper | Transaktionsgrenzen |

| Dokumentation aus Code | Performance-kritische Pfade |

Wer das sauber trennt, bekommt den Nutzen ohne naive Abhängigkeit. Die KI wird dann kein Ersatz für Engineering. Sie wird ein produktiver Vorarbeiter für die Teile, die Menschen sowieso nicht von Hand lieben.

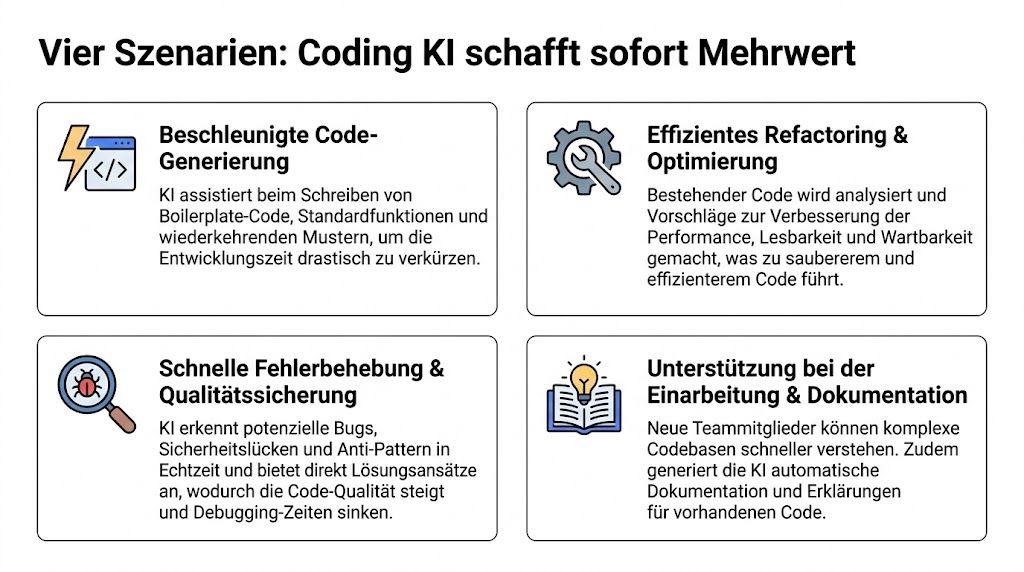

Vier Szenarien in denen Coding KI sofort Mehrwert schafft

Der Nutzen von coding ki zeigt sich nicht in abstrakten Visionen. Er zeigt sich an den Stellen, an denen Teams jeden Tag Zeit verlieren.

Die IHK Rhein-Neckar beschreibt für den deutschen Markt, dass KI-Coding-Assistenten Entwicklungsaufgaben um bis zu 56 Prozent beschleunigen können, vor allem durch kontextbasierte Vorschläge für Routinearbeit wie Boilerplate-Code und Prototyping. Genau das spürt man in den folgenden Situationen.

Onboarding in einer alten Codebasis

Der neue Entwickler ist da. Das Produkt ist seit Jahren gewachsen. Es gibt Module mit Historie, aber wenig aktuelle Doku.

Hier ist coding ki stark, wenn man sie nicht blind fragt, sondern gezielt. Zum Beispiel:

Erkläre mir diesen Service in Bezug auf Datenfluss, Seiteneffekte, Fehlerbehandlung und Abhängigkeiten. Zeige mir ausserdem, welche Teile Legacy sind und wo ich bei einer Änderung zuerst Tests lesen sollte.

Das ersetzt keinen Mentor. Aber es reduziert die ersten Stunden stumpfer Orientierung. Die KI kann bestehende Klassen, Kommentare und Tests in eine lesbare Einführung übersetzen. Für Product Owner ist das ebenfalls hilfreich, wenn sie technische Auswirkungen einer Änderung verstehen müssen, ohne sich durch den ganzen Stack zu arbeiten.

Code-Review mit wiederverwendbaren Prompt-Templates

Automatische Reviews funktionieren nicht gut, wenn der Prompt weich formuliert ist. Sie funktionieren besser, wenn das Team eine feste Review-Struktur vorgibt.

Ein brauchbares Template sieht eher so aus:

- Architektur prüfen: Entspricht die Änderung bestehenden Layer-Grenzen und Patterns?

- Sicherheit prüfen: Siehst du riskante String-Konkatenation, unsichere Defaults oder fehlende Validierung?

- Wartbarkeit prüfen: Gibt es Duplikate, unnötige Komplexität oder irreführende Namen?

- Tests prüfen: Welche Fälle fehlen wahrscheinlich?

Damit wird aus einem diffusen Chat ein wiederholbarer Review-Schritt. Die KI ersetzt den Review nicht. Sie liefert eine erste, oft nützliche Gegenlese.

Dokumentation aus Kommentaren und Code ableiten

Viele Teams dokumentieren zu spät. Oder gar nicht. Dann lebt Wissen nur in Köpfen.

Coding ki ist stark darin, aus verteilten Informationen saubere Doku zu erzeugen. Aus Funktionssignaturen, Kommentaren, OpenAPI-Snippets und Tests entsteht ein Ausgangspunkt für README, Modulbeschreibung oder Übergabedokument. Besonders wertvoll ist das bei internen Tools, die technisch stabil sind, aber organisatorisch schlecht erklärt.

Code zwischen Sprachen übersetzen

Der vierte Fall ist erstaunlich nützlich. Ein Team hat ein internes Python-Skript, das jetzt als TypeScript-Service in eine bestehende Plattform integriert werden soll.

Die KI kann das nicht nur syntaktisch übersetzen. Sie kann auch idiomatischer arbeiten, etwa Datentypen explizit machen, asynchrone Muster anpassen und aus losem Skriptcode eine Struktur bauen, die besser zu einem produktiven Service passt.

Wenn du Sprachübersetzung mit coding ki nutzt, lass immer zusätzlich prüfen, ob auch das Laufzeitmodell übersetzt wurde. Syntax ist leicht. Semantik ist der eigentliche Test.

Diese vier Szenarien haben etwas gemeinsam. Es sind keine Science-Fiction-Fälle. Es sind normale Engpässe in realen Teams.

Das Risiko der Schatten-IT im Entwicklungsteam

Ein Unternehmen verbietet Copilot oder ähnliche Werkzeuge aus Compliance-Gründen. Drei Monate später nutzt ein Teil des Teams trotzdem KI. Nicht offiziell. Sondern über private Accounts, Browser-Tabs oder das Handy.

Das ist keine Ausnahme. Das ist vorhersehbar.

Die MIT- und Princeton-Ergebnisse, zusammengefasst bei The AI Software Company, beschreiben eine durchschnittliche Produktivitätssteigerung von 26 % durch Tools wie GitHub Copilot, bei weniger erfahrenen Entwicklern bis zu 39 %. Wenn ein Werkzeug im Alltag spürbar hilft, verschwindet es nicht durch ein Rundschreiben.

Warum Verbote in der Praxis scheitern

Entwickler umgehen Regeln nicht immer aus Trotz. Oft umgehen sie Regeln, weil sie liefern müssen.

- Deadlines bleiben real: Das Ticket wartet nicht auf die nächste Governance-Runde.

- Private Nutzung ist trivial: Ein Browserfenster reicht oft schon.

- Der Nutzen ist direkt spürbar: Vor allem bei Testgerüsten, Boilerplate und Refactoring.

- Das Verbot schafft keine Alternative: Dann gewinnt der einfachste Weg.

Das Resultat ist schlechter als eine geregelte Freigabe. Die Nutzung findet weiter statt, aber ohne Logging, ohne Richtlinien, ohne Datenklassifizierung und ohne gemeinsame Standards für Review.

Was Schatten-IT technisch gefährlich macht

Der gefährlichste Teil ist nicht nur der einzelne Prompt. Es ist die fehlende Steuerung.

| Offiziell eingeführtes Tool | Schatten-IT |

|---|---|

| Klare Regeln für erlaubte Daten | Jeder entscheidet spontan selbst |

| Zentrale Verträge und Zugriffskontrolle | Private Konten ohne Kontrolle |

| Review-Prozesse für KI-Code | Uneinheitliche Qualität |

| Nachvollziehbarkeit | Blindflug |

Ein Verbot ohne nutzbare Alternative verschiebt das Problem nur an einen Ort, an dem Security und Compliance es nicht mehr sehen.

Wer coding ki in Unternehmen verantwortet, muss deshalb ehrlicher auf das Team schauen. Die Frage ist selten, ob Menschen KI nutzen wollen. Die Frage ist, ob sie das kontrolliert oder heimlich tun.

InnoGPT Die sichere Plattform als strategische Lösung

Ich habe diese Diskussion in vielen Teams gesehen. Entwickler wollen die Produktivitätsgewinne sofort mitnehmen. Security, Legal und Datenschutz ziehen zu Recht die Handbremse, sobald interner Code, Architekturdetails oder Kundendaten in US-Dienste fliessen könnten. Genau dort liegt das europäische Dilemma: Der Nutzen ist real, aber ein unkontrollierter Einsatz kann geistiges Eigentum, Vertraulichkeit und DSGVO-Pflichten beschädigen.

Für Unternehmen in Europa reicht deshalb keine einzelne IDE-Erweiterung. Sie brauchen einen Betriebsrahmen, in dem generative Modelle nutzbar sind, ohne dass jedes Team seine eigene Risikoentscheidung trifft.

Warum viele Unternehmen an genau diesem Punkt blockieren

In der Praxis scheitert die Einführung selten am Modell selbst. Sie scheitert daran, dass zwischen technischer Möglichkeit und regulatorischer Verantwortung eine Lücke bleibt. Der Fachbereich sieht schnellere Umsetzung. Die Entwicklung sieht weniger Routinearbeit. Datenschutz und Einkauf sehen ungeklärte Auftragsverarbeitung, Datenabflüsse und fehlende Kontrollrechte.

Das ist kein organisatorisches Nebenthema. Es entscheidet darüber, ob Coding KI als Unternehmensfähigkeit eingeführt wird oder als Grauzone bestehen bleibt.

Was eine Plattform im Unternehmenskontext leisten muss

Eine brauchbare Plattform für coding ki muss mehr abdecken als Chat und Autovervollständigung. Sie muss technische Nutzung, Zugriffssteuerung und Compliance zusammenbringen.

Dazu gehören typischerweise:

- Zentraler Zugriff auf mehrere Modelle: damit Teams nicht pro Anwendungsfall neue Einzelverträge und neue Risiken erzeugen

- EU-Hosting und klar geregelte Datenverarbeitung: damit Verantwortlichkeiten und Speicherorte prüfbar bleiben

- Keine Verwendung von Inhalten für Modelltraining: damit proprietärer Code und internes Wissen nicht in fremde Trainingsprozesse geraten

- SSO, Rollen und Mandantentrennung: damit Nutzung an bestehende Identitäten und Berechtigungen gekoppelt ist

- Vorgaben für sichere Nutzung im Team: damit technische und organisatorische Maßnahmen nicht nur auf dem Papier stehen, sondern im Alltag funktionieren. Dazu gehören die technischen und organisatorischen Maßnahmen für den sicheren KI-Einsatz

An dieser Stelle passt eine Plattform wie innoGPT in das Bild. Nicht als weiteres Spielzeug für Entwickler, sondern als kontrollierte Schicht zwischen Team und Modellzugang. Wenn EU-Hosting, Zero Retention und SSO sauber umgesetzt sind, wird aus einer riskanten Einzelentscheidung ein steuerbarer Prozess.

Der strategische Unterschied im Betrieb

Für einen einzelnen Entwickler wirkt der Direktzugang zu einem US-Anbieter oft schneller. Im Unternehmensbetrieb zählt etwas anderes: Wer darf welche Modelle nutzen, mit welchen Daten, unter welchen Regeln und mit welcher Nachvollziehbarkeit?

Genau daran trennt sich Experiment von Betrieb.

Eine abgesicherte Plattform beantwortet diese Fragen vor dem Prompt, nicht erst nach einem Vorfall. Das ist der eigentliche Unterschied. Teams können generative Modelle weiter produktiv einsetzen, ohne bei jedem Ticket neu abzuwägen, ob sie gerade vertraulichen Code, interne Architektur oder personenbezogene Daten in den falschen Kanal kopieren.

Wer dieses Spannungsfeld ernst nimmt, landet fast immer beim gleichen Schluss. Produktivität und Compliance lassen sich nicht über Appelle ausbalancieren. Dafür braucht es eine Plattform, die beides technisch erzwingt.

Praktische Schritte zur sicheren KI-Integration im Team

Coding ki scheitert selten an der Modellqualität. Sie scheitert meist an schlechter Einführung. Wenn Teams ohne Regeln starten, bekommen sie ungleichmässige Ergebnisse, unsaubere Prompts und Pull Requests, die mehr Reviewzeit fressen als sie sparen.

Die bessere Reihenfolge ist schlicht. Erst Leitplanken, dann Roll-out.

Mit Datenklassen statt Bauchgefühl anfangen

Nicht jeder Prompt ist gleich sensibel. Deshalb braucht das Team zuerst eine einfache Einteilung.

- Grün: allgemeine Programmierfragen, öffentliche Framework-Beispiele, unsensible Hilfsfunktionen

- Gelb: interne Schnittstellen, nicht öffentliche Strukturinformationen, abstrahierte Ticketinhalte

- Rot: proprietäre Logik, Kundendaten, sicherheitsrelevante Details, geheime Schlüssel, produktive Incidents

Diese Einteilung muss kurz sein. Wenn sie auf zehn Seiten Policy basiert, nutzt sie im Sprint niemand.

Prompt-Hygiene als Teamstandard

Viele Probleme lassen sich verhindern, wenn Prompts präziser und datensparsamer werden.

Ein paar Regeln funktionieren zuverlässig:

- Abstrahiere zuerst. Beschreibe das Problem, bevor du Originalcode einfügst.

- Gib Architekturgrenzen mit. Sag der KI, welche Patterns erlaubt sind und welche nicht.

- Fordere Prüfbares an. Bitte um Tests, Annahmen und bekannte Unsicherheiten.

- Lass Alternativen ausgeben. Ein guter Prompt fragt nach zwei Lösungswegen mit Trade-offs.

Ein Beispiel für einen Review-Prompt:

Prüfe den folgenden Patch auf Sicherheitsprobleme, Architekturabweichungen, fehlende Tests und unnötige Komplexität. Markiere Annahmen explizit und nenne nur Punkte, die du technisch begründen kannst.

KI-Code anders reviewen als Menschen-Code

KI-generierter Code braucht keinen weicheren Review. Er braucht oft einen härteren.

| Prüffeld | Worauf Reviewer achten sollten |

|---|---|

| Sicherheit | Eingabevalidierung, Authentisierung, Geheimnisse, unsichere Defaults |

| Architektur | Layer-Verstösse, neue Abhängigkeiten, Duplikate vorhandener Patterns |

| Betrieb | Logging, Fehlertoleranz, Timeouts, Seiteneffekte |

| Tests | Fehlpfade, Randfälle, realistische Assertions |

Technische und organisatorische Leitplanken sollten zusammen definiert werden. Eine brauchbare Orientierung für diesen Teil liefern technische und organisatorische Massnahmen im Unternehmenskontext.

Klein starten, hart messen

Ein Pilot mit einem klaren Scope funktioniert besser als ein grosser Freiflug. Nimm ein Team, zwei oder drei wiederkehrende Aufgaben und feste Qualitätskriterien.

Geeignete Startfelder sind meist:

- Boilerplate und Standardfunktionen

- Unit-Test-Entwürfe

- Dokumentation aus bestehendem Code

- Refactoring-Vorschläge für unkritische Module

Wenn das Team dabei lernt, wann coding ki zuverlässig hilft und wann sie eher Blendwerk produziert, entsteht Vertrauen auf Basis von Erfahrung statt Marketing.

Fazit Produktivität und Datensouveränität sind kein Widerspruch

Coding ki ist längst kein Experiment mehr. Für viele Teams ist sie ein echter Hebel bei Boilerplate, Tests, Doku und Übersetzungsarbeit zwischen Sprachen und Systemen.

Der Fehler liegt nicht im Einsatz selbst. Der Fehler liegt im unkontrollierten Einsatz. Wer aus Angst alles verbietet, treibt Entwickler in Schatten-IT. Wer alles freigibt, riskiert Datenabfluss, Architekturdrift und Sicherheitsprobleme.

Europäische Unternehmen brauchen deshalb keinen Rückzug von generativer KI. Sie brauchen einen belastbaren Betriebsrahmen. Dazu gehören saubere Auftragsverarbeitung, ein klarer Umgang mit Drittstaatentransfers, technische Zugriffskontrolle, definierte Review-Regeln und ein Modellzugang, der nicht zur Compliance-Lücke wird.

Dann wird aus coding ki kein Risiko-Shortcut, sondern ein ernstzunehmendes Werkzeug im Engineering-Alltag. Produktivität und Datensouveränität passen zusammen. Aber nur, wenn man beides als Systemfrage behandelt.

Wer coding ki im Unternehmen nutzen will, ohne proprietären Code unkontrolliert nach aussen zu geben, sollte sich innoGPT als mögliche Plattform ansehen. Der Ansatz ist nicht ein weiteres Einzeltool, sondern ein kontrollierter Zugang zu generativen Modellen mit EU-Hosting, Zero Retention und Integration in bestehende Unternehmensprozesse.

Lass dir innoGPT in 15 Minuten zeigen.

Wir nehmen uns gerne Zeit für dich!